Еще 10–15 лет назад суперкомпьютеры были чем-то вроде элитарного штучного инструмента, доступного в основном ученым из засекреченных ядерных центров и криптоаналитикам спецслужб. Однако развитие аппаратных и программных средств сверхвысокой производительности позволило освоить промышленный выпуск этих машин, а число их пользователей в настоящее время достигает десятков тысяч. Сегодня использование высокопроизводительных вычислительных систем (суперкомпьютеров) в научных и инженерных проектах является одним из приоритетных направлений технологического прорыва цивилизации в борьбе за выживание.

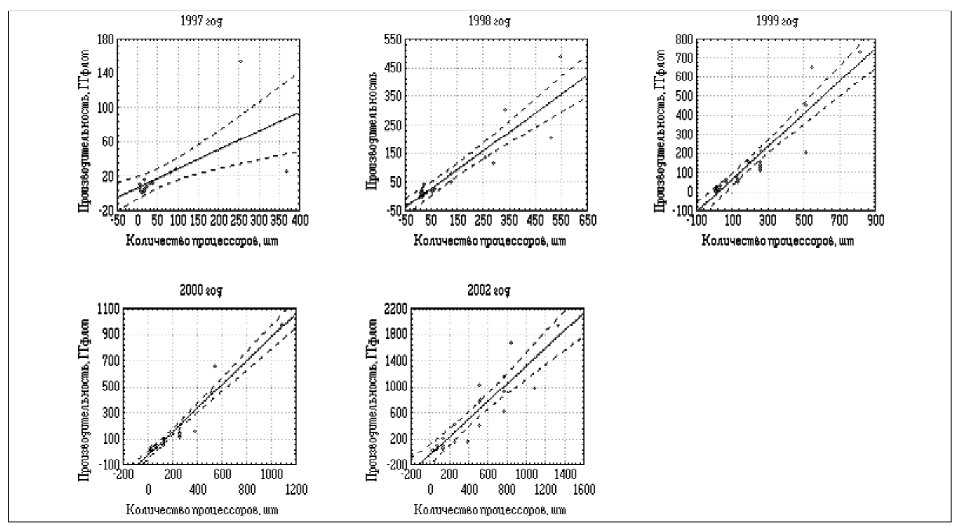

Мировой рынок суперкомпьютерной индустрии

Фактически в наши дни весь мир переживает подлинный бум суперкомпьютерных проектов, результатами которых активно пользуются не только такие традиционные потребители высоких технологий как аэрокосмическая, автомобильная, судостроительная и радиоэлектронная отрасли промышленности, но и важнейшие области современных научных знаний: астрономия, физика, химия, медицина, микробиология, океанология, метеорология и др.

Общая стоимость рынка суперкомпьютеров по оценкам экспертов составляет величину порядка $5 млрд. в год, что не так и много по сравнению со стоимостью рынка всей индустрии информационных технологий: только в США его стоимость в государственном секторе достигает порядка $40 млрд. Однако именно в суперкомпьютерной индустрии уже в ближайшие годы можно ожидать по истине революционные прорывы, связанные с перспективными технологиями, применение которых будет иметь далеко идущие последствия для человечества.

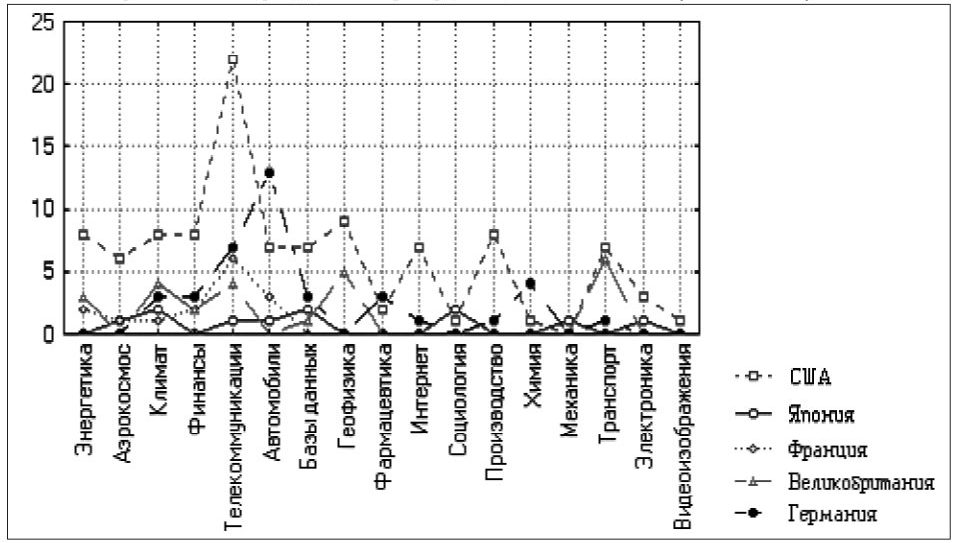

Распределение количества суперкомпьютеров по пяти ведущим странам и областям их применения, полученные с помощью методов многомерного анализа данных списка 500 самых мощных компьютеров мира2, представлено на рис. 1. Анализ диаграммы красноречиво свидетельствует о лидирующем положении США практически во всех областях (энергетическом комплексе, аэрокосмической промышленности, финансовых операциях, производстве, телекоммуникационных системах, Интернете и базах данных), за исключением автомобильной и химической промышленности, где пальма первенства принадлежит Германии.

При этом в фармацевтике и на транспорте США практически на равных используют суперЭВМ наряду с Германией и Великобританией.

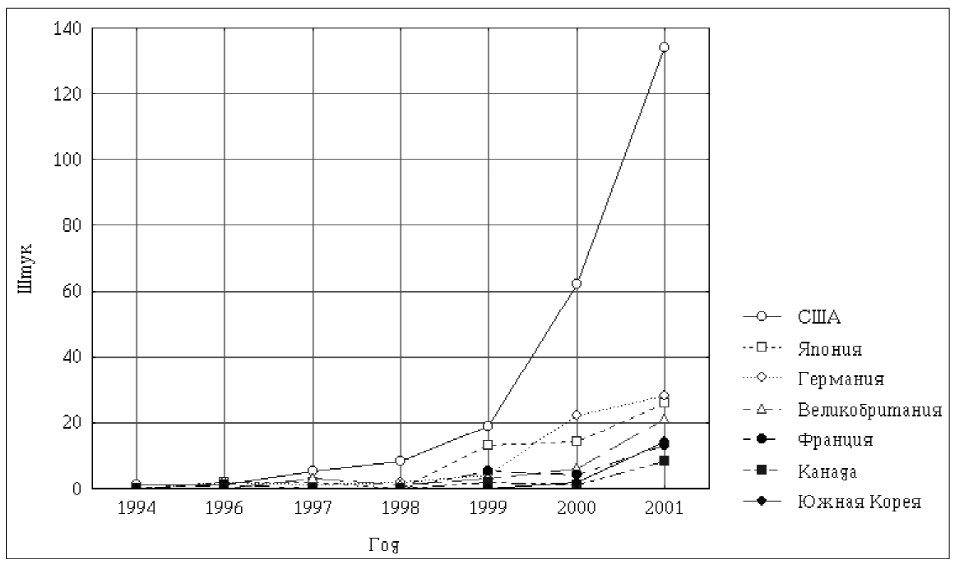

Динамика роста количества установленных суперЭВМ в ведущих странах за последние 7 лет, полученная на основе этих же данных, представлена на рис. 2.

На графике хорошо видно, что начиная с 2000 года США взяли курс на достижение абсолютного лидерства в использовании суперЭВМ: если в 1999 г. количество установленных за год компьютеров этого класса в США составляло 70% от их общего количества в ведущих станах мира (27), то уже в 2001 г. США опередили своих конкурентов по темпам роста на 27%, установив за год 134 компьютера против 110 в других странах. При этом в самих США темпы роста за этот период достигли рекордного значения – 226%. На этом же графике наглядно представлено острое состязание двух самых сильных конкурентов США в области суперкомпьютеров – Японии и Германии, в котором на долю последней приходится резкий скачок с 4 до 22 установленных за период с 1999 по 2001 гг. высокопроизводительных вычислительных систем (450%). В целом в США к концу 2001 г. было установлено 230 суперкомпьютеров из 500 во всем мире (46%), а 200 суперкомпьютеров – в ведущих странах, из которых 57 было установлено в Японии и 59 – в Германии.

По общему количеству процессоров в вычислительных системах данного класса США так же вышли на первое место, имея в своем арсенале 109681 (68%) единиц из 161674, установленных во всем мире. Еще один своеобразный рекорд США установили по суммарному значению пиковой производительности всех своих суперкомпьютеров, доведя ее до 53 Тфлоп (TFLOP3) (45%) из 119 Тфлоп всех стран мира4. Однако главный и самый внушительный рекорд состоит в том, что 89% (443) всех суперЭВМ из 500 собрано американскими фирмами (IBM, Compaq, Dell, Intel, SGI, Cray, Sun, HewlettPackard) и лишь 10% (49) – японскими (NEC, Hitachi, Fujitsu), в то время как на долю всех остальных стран приходится 1%.

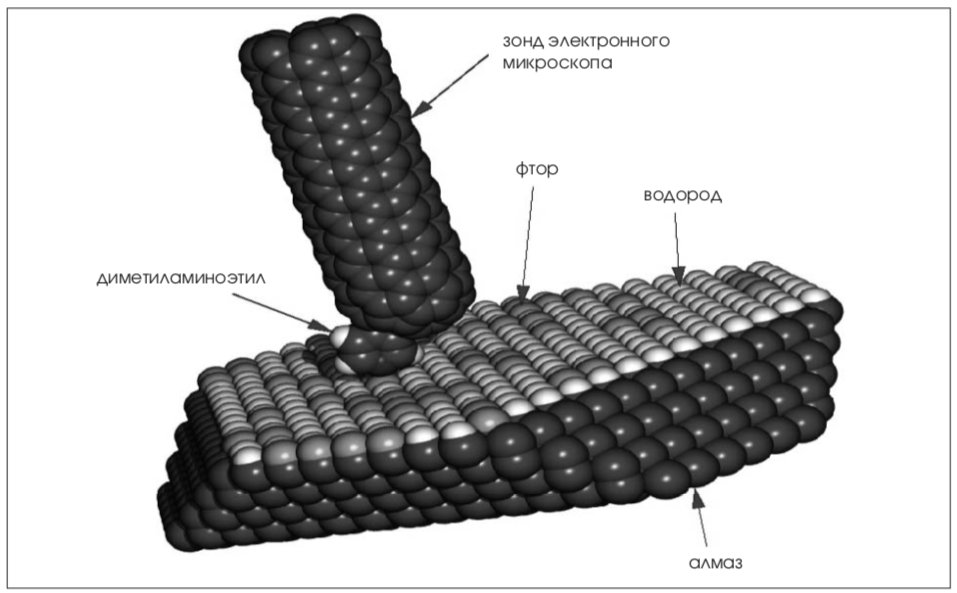

Одним из важнейших научно-практических результатов применения технологии суперкомпьютеров стало появление самостоятельного направления развития науки и техники – высокоточной виртуальной трехмерной визуализации объектов и процессов на основе их математического моделирования. Целый ряд сложнейших физических и химических процессов, связанных с высокой температурой, радиоактивностью, нестабильностью, агрессивностью вещества сегодня воспроизводится в виртуальных лабораториях без натурных экспериментов, побочных эффектов и риска для жизни окружающих. Человек проникает в тайны материального мира, живых организмов, проектирует новые материалы, образцы техники и испытывает их с помощью суперкомпьютеров.

В США развитие и применение суперкомпьютеров (High performance computing – HPC) за последние десять лет получило достаточно высокую отдачу в виде конкретных научно-технических проектов как в гражданской, так и военной областях. При этом основная тенденция развития данного направления заключается в широком обмене опытом, программным обеспечением, алгоритмами и специалистами между всеми участниками проектов и их заказчиками независимо от ведомственной принадлежности.

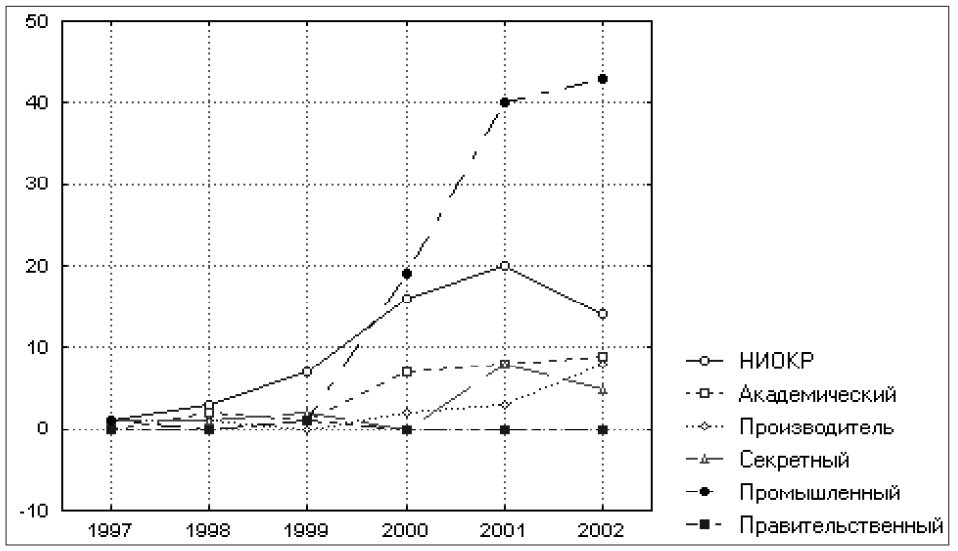

На диаграмме (рис. 3) представлена динамика распределения суперкомпьютеров в США по объектам их использования. Анализ диаграммы показывает, что 2000 год для высокопроизводительных вычислений в США стал решающим с точки зрения промышленного использования технологии суперкомпьютеров, а 2001 год – переломным, когда общее количество установленных компьютеров в промышленности превысило их количество в академических и научно-исследовательских организациях. Это наглядно демонстрирует переход технологий высокопроизводительных вычислений из чисто научных проектов непосредственно в производство. Наряду с этим прослеживается тенденция увеличения количества установленных суперЭВМ на секретных объектах и объектах производителя, что свидетельствует о стратегической важности данного направления развития информационных технологий для национальной безопасности США.

Типы архитектуры суперкомпьютеров

Как и в любой классификации деление объектов на группы всегда условно: понятие высокого или полного человека на протяжении последних 20 лет в нашем представлении постоянно менялось. Нечто подобное сейчас происходит и с классификацией суперкомпьютеров, где технологии устаревают быстрее, чем их успевают освоить. Тем не менее к настоящему времени в мире сложилась общепринятая градация вычислительных систем, в которой суперкомпьютеры занимают одно из самых почетных мест.

По существующей классификации к суперкомпьютерам или суперЭВМ относятся мощные многопроцессорные вычислительные машины с быстродействием сотни миллионов – десятки миллиардов арифметических операций в секунду, емкостью оперативной памяти сотни Гбайт5 и внешней (дисковой) памяти десятки Тбайт6, разрядностью машинного слова 64 или 128 бит.

Создать такую высокопроизводительную ЭВМ по современной технологии на одном микропроцессоре не представляется возможным ввиду ограничения, обусловленного конечным значением скорости распространения электромагнитных волн (300 000 км/с), поскольку время распространения сигнала на расстояние несколько миллиметров (линейный размер микросхемы) при быстродействии 100 млрд арифметических операций в секунду становится соизмеримым со временем выполнения одной операции. Поэтому суперЭВМ создаются в виде параллельных многопроцессорных вычислительных систем.

Используя параллельную обработку информации, теоретически можно наращивать вычислительную мощность компьютера путем простого добавления новых процессоров до бесконечности. Однако с ростом количества процессоров возрастает и число конфликтов при обращении процессоров к общим ресурсам системы, что, в конечном итоге, сказывается на эффективности вычислительной системы7.

Существует несколько разновидностей суперкомпьютерной архитектуры, позволяющих решить эту проблему. Однако у каждой из них есть и свои недостатки.

Под архитектурой вычислительной системы обычно понимается совокупность характеристик и параметров, определяющих функционально-логическую и структурную организацию системы.

Понятие архитектуры охватывает общие принципы построения и функционирования, наиболее существенные для пользователей, которых больше интересуют возможности систем, а не детали их технического исполнения.

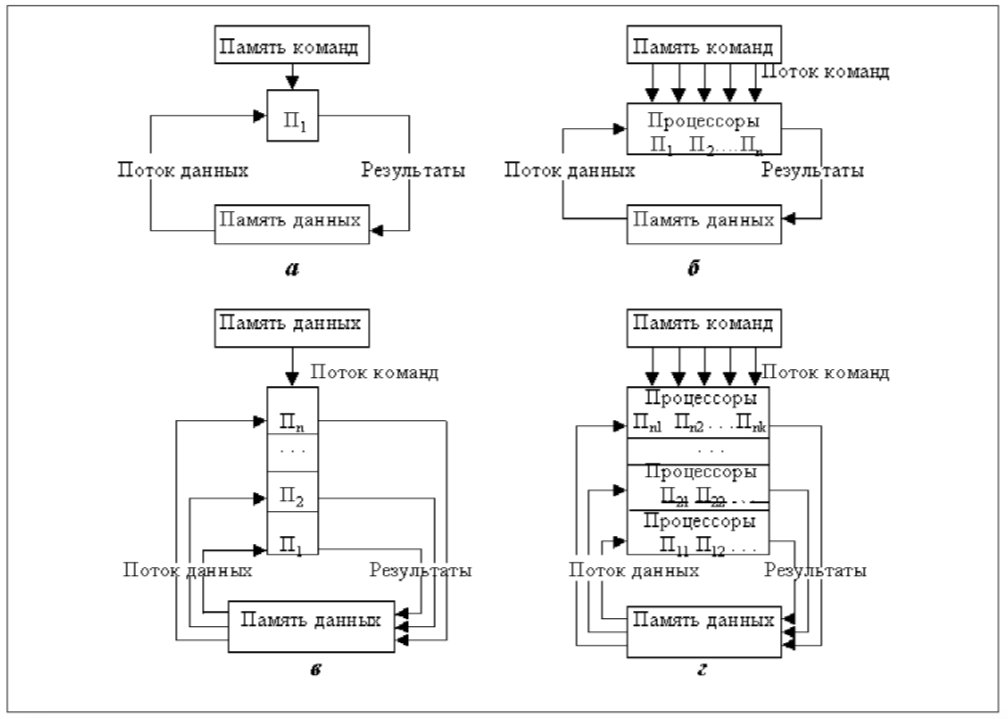

В соответствии с классификацией, предложенной М.Флинном еще в начале 60-х годов прошлого столетия, параллельные вычислительные системы имеют несколько разновидностей (рис 4). При этом в основу данной классификации заложено два возможных вида параллелизма: независимость потоков заданий (команд), существующих в системе, и независимость (отсутствие логической связанности) данных, обрабатываемых в каждом потоке:

- Магистральные (конвейерные), в которых процессоры одновременно выполняют разные операции над последовательным потоком обрабатываемых данных; по принятой классификации такие системы относятся к системам с многократным потоком команд и однократным потоком данных МКОД (MISD – Multiple Instruction Single Data);

- Векторные, в которых все процессоры одновременно выполняют одну команду над различными данными – однократный поток команд с многократным потоком данных ОКМД (SIMD – Single Instruction Multiple Data);

- Матричные, в которых процессоры одновременно выполняют разные операции над несколькими последовательными потоками обрабатываемых данных – многократный поток команд с многократным потоком данных МКМД (MIMD – Multiple Instruction Multiple Data)8.

а – SISD (однопроцессорная),

б – MISD (конвейерная);

в – SIMD (векторная);

г – MIMD (матричная).

В суперЭВМ используются все три варианта архитектуры параллельных вычислительных систем.

Классический тип суперкомпьютерной архитектуры (однопроцессорная и конвейерная) использует общую оперативную память, обращение к которой осуществляется через системную шину. Единое пространство оперативной памяти значительно упрощает программирование за счет более удобных механизмов синхронизации между задачами. Однако с ростом числа процессоров наличие общей памяти приводит к возрастанию нагрузки на системную шину, которая в конце концов перестает обслуживать обмен данными между оперативной памятью и процессорами в требуемом темпе. Добавление локальной кэш-памяти в каждый процессор несколько снижает остроту проблемы. Тем не менее вне зависимости от наличия локальной кэш-памяти системная шина все равно является уязвимым местом такой архитектуры при 8 и более процессорах.

Параллельная архитектура (векторная и матричная) позволяет избежать проблем с системной шиной за счет отсутствия общей для всех процессоров оперативной памяти. Каждый процессор снабжается своей локальной памятью. Чтобы осуществить доступ к локальной памяти другого процессора, используется сеть связи, объединяющая процессоры в систему. Таким образом, в параллельной архитектуре удается снизить нагрузку на шину, ведущую к локальной памяти процессоров, поскольку здесь она обслуживает только запросы на доступ именно к этой памяти, а не каждый запрос на доступ к общей оперативной памяти. Это позволяет строить суперкомпьютеры из сотен и даже тысяч процессоров.

Основным недостатком параллельной архитектуры является сложность программирования, особенно для задач, которым необходима память, превышающая размер локальной оперативной памяти одного процессора. Синхронизация также затруднена, особенно если ее требуется осуществить между параллельными ветвями алгоритма, выполняемыми процессорами, которые разделяет значительное расстояние в сети связи.

Как же решаются проблемы, связанные с функционированием параллельной архитектуры? Для этого в последнее время широко используется так называемый наращиваемый мультипроцессор (НМП), являющийся гибридом векторной и матричной архитектуры. НМП состоит из вычислительных узлов, представляющих собой матрицу или по английской терминологии решетку (grid) с несколькими процессорами и общей для них оперативной памятью. При этом вычислительные узлы объединяются в единую систему с помощью сети связи, которая обслуживает запросы на доступ в память других узлов. Для пользователя вся оперативная память НМП представляет собой единое адресуемое пространство. В результате можно пользоваться программными моделями, разработанными для традиционных архитектур и одновременно увеличивать 9 число процессоров с ростом рабочей нагрузки .

В целом современная технология организации вычислений опирается на два вида параллелизма: крупноблочный и мелкозернистый. Это деление достаточно условно, но тем не менее можно заметить следующее. Крупноблочный параллелизм свойственен вычислительным системам, составленным из небольшого числа (десятки, сотни) мощных компьютеров, соединенных сетью связи того или иного вида.

Мелкозернистый параллелизм свойственен вычислительным системам, составленным из огромного числа (десятки, сотни тысяч) относительно простых процессорных элементов. Связи между процессорными элементами регулярны и очень часто организованы по принципу близкодействия. Как правило, такие системы узко специализированы. Сам термин «мелкозернистый параллелизм» говорит об элементарности и скоротечности отдельного вычислительного действия. Характерной чертой мелкозернистого параллелизма является примерно одинаковая интенсивность вычислений 10 и обмена информацией .

В настоящее время вычислительные системы с векторной архитектурой составляют только 8,8% против 91,2% – с матричной, что связано со спецификой решаемых ими задач. Тем не менее, японская фирма NEC уже собрала самый мощный суперкомпьютер в мире с векторной архитектурой, получивший название «Симулятор Земли» (Earth Simulator11), с астрономической пиковой производительностью – 38 Тфлоп и почти догнала США по суммарной производительности (50 Тфлоп)!!!

Суперкомпьютеры для звездных войн

Одной из первых крупномасштабных попыток совершить прорыв в использовании суперкомпьютеров в интересах военно-технического и военностратегического превосходства является так называемая программа «звездных войн», инициированная администрацией Рональда Рейгана еще в марте 1983 г. В рамках проекта Стратегической оборонной инициативы – СОИ (Strategic Defense Initiative – SDI) предполагалось создать и развернуть эшелонированную систему противоракетной обороны (на земле, в воздухе и в космосе), что в конечном итоге должно было дать существенное превосходство США над СССР в случае ядерной войны12.

Среди научно-технических и инженерноконструкторских задач, связанных с осуществлением этого фантастического проекта, особо выделялась задача селекции ложных целей на заатмосферном участке полета ядерных боеголовок баллистических ракет, для решения которой требовался колоссальный объем вычислений по тем временам – миллиарды операций в секунду с числами, представленными в формате с плавающей точкой.

Несмотря на то, что к началу 80-х годов в СССР и в США уже существовали испытанные варианты систем ПРО наземного базирования для прикрытия важнейших стратегических объектов, их эффективность ограничивалась гарантированным поражением ракет противника преимущественно на атмосферном участке, когда боеголовки при входе в плотные слои атмосферы подвергаются сильному нагреву и могут быть идентифицированы на фоне ложных целей по скорости. В условиях полета на заатмосферном участке в безвоздушном пространстве отличить боевые цели от ложных при равных скоростях (до 7 км/с.) и физических размерах практически невозможно без использования космических датчиков радиолокационного слежения. Кроме того, для управления орбитальной группировкой космических платформ, на которых предполагалось разместить средства обнаружения и поражения боеголовок и ракет (кинетических, лазерных и др.) требовалось, чтобы большая часть вычислений проводилась непосредственно на месте, т.е. в космосе в условиях ограниченного ресурса времени для принятия решения (150-300 с), что накладывало значительные ограничения не только на быстродействие и память, но и вес, объем, потребляемую энергию и надежность компьютеров и их программного обеспечения13.

Принимая во внимания достигнутый к тому времени уровень развития элементной базы и архитектуры компьютеров, решить подобную задачу можно было только за счет использования комплекса технологий: сверхбыстродействующих и сверхбольших интегральных микросхем, параллельной и векторной обработки данных, методов искусственного интеллекта и высоконадежного программного обеспечения.

Например, суперкомпьютер «Cray-1» (рис. 5) американской компании Cray Research Inc. в 1976 году выполнял 240·106 арифметических операций с плавающей точкой в секунду (240 Мфлоп) и стоил от $4 до $11 млн. в зависимости от комплектации. Стоимость таких вычислительных систем становилась просто астрономической, если к цене оборудования добавлялись расходы на изготовление программного обеспечения.

С этой целью в рамках программы СОИ были открыты специальные технологические подпрограммы, получившие название «стратегические сверхпроизводительные вычисления» (Strategic Supercomputing), «сверхбольшие интегральные микросхемы» (Very Large Integrated Circuit – VLIC), «сверхскоростные интегральные микросхемы» (Very High Speed Integrated Circuit – VHSIC), «стратегическое адаптируемое и надежное программное обеспечение» (Strategic Adaptable And Reliable Software – STARS)14.

Результаты не замедлили себя ждать. Созданный в 1988 году суперкомпьютер «Cray-YMP» объединял уже до 16 процессоров, обладал пиковой производительностью 2670 Мфлоп15 и стоил от $2,5 до $16 млн. Тем не менее, для реализации проекта СОИ этого было явно мало: по оценкам американских специалистов бортовые вычислительные системы космического базирования должны были обладать пиковой производительностью не менее 50 Гфлоп16.

И здесь не лишним будет упомянуть тот факт, что к началу открытия работ в рамках программы СОИ в Советском Союзе тоже были достигнуты ощутимые результаты в архитектуре суперкомпьютеров. Убедиться в этом американцы смогли еще во время совместных космических полетов по программе «Союз-Аполлон», когда в подмосковном ЦУПе обработка телеметрической информации на БЭСМ-6 проводилась быстрее почти на полчаса, чем в Хьюстоне. Как шутили наши конструкторы – «американцы использовали свои суперкомпьютеры для расшифровки телеметрии советских МБР17». Даже сегодня, спустя много лет остается только удивляться тому высочайшему уровню, который был достигнут в отечественных суперкомпьютерах.

Многопроцессорный вычислительный комплекс «Эльбрус-1», выпущенный в 1979 году, включал 10 процессоров и базировался на схемах средней интеграции. В этой машине советские ученые опередили американцев, создав симметричную многопроцессорную систему с общей памятью. По принципам построения система команд «Эльбрусов» близка системе команд машин компании Burroughs, считающейся нетрадиционной. Машина «Эльбрус-1» обеспечивала быстродействие от 1,5 Мфлоп до 10 Мфлоп, а «Эльбрус-2» – более 100 Мфлоп.

«Эльбрус-2», работа над которым была завершена в 1985 году, также представлял собой симметричный многопроцессорный вычислительный комплекс из 10 суперскалярных процессоров на матричных БИС, которые выпускались в Зеленограде. «Эльбрусы» вообще несли в себе ряд революционных новшеств. Суперскалярность процессорной обработки, симметричная многопроцессорная архитектура с общей памятью, реализация защищенного программирования с аппаратными типами данных – все эти возможности появились в отечественных машинах раньше, чем на Западе. Особо следует выделить создание единой операционной системы для многопроцессорных комплексов (которым руководил Борис Бабаян, в свое время отвечавший за разработку системного программного обеспечения БЭСМ-6). Одной из важнейших задач этой ОС было управление параллельно выполняющимися процессами и их синхронизация – одна из самых сложнейших задач в области высокопроизводительных вычислений18.

К сожалению, ориентация отечественной суперкомпьютерной индустрии в основном на военные проекты привела эту отрасль к началу 90-х годов на высочайшем взлете новых идей в глубочайший финансовый тупик, когда экономика страны была уже не в силах содержать дорогостоящие проекты военно-промышленного комплекса, конверсия которых выглядела в глазах чиновников более, чем сомнительно: не случайно именно в этот период страну захлестнул вал дешевых импортных персональных компьютеров. Многие высококлассные специалисты оказались перед выбором: либо работать на Западе, либо торговать ширпотребом в России. И нет ничего удивительного в том, что полсотни советских специалистов, обладавших большим опытом в строительстве суперкомпьютеров, перейдя под крыло фирмы Sun Microsystems, перестали создавать сами компьютеры, но преуспели в разработке компиляторов Си, Паскаля и Фортрана для компьютерных платформ Sun.

Вот высказывание одного из научных руководителей Sun Microsystems Джона Гейджа о квалификации российских специалистов. «Мы увидели высочайший уровень подготовки российских специалистов в области системных архитектур, компиляторов и программного обеспечения в целом. После двадцати лет успешного развития информационных технологий, прошедших под знаком повышения производительности аппаратных средств, на первое место начинают выходить вычислительные алгоритмы. Над их совершенствованием в Соединенных Штатах долгое время никто не задумывался: задача эта не из легких. Если ваши программы выполнялись медленно, проще было заменить аппаратные средства более производительными, благо такая возможность всегда имелась. В России, где компьютер долгое время оставался редкостью, интеллектуальные силы были направлены на совершенствование алгоритмов. Как стало ясно теперь, в искусстве оптимизации алгоритмов российские программисты оставили позади весь остальной мир».

А между тем в самой Америке бум персональных компьютеров не заслонил главной цели развития информационных технологий – достижения технологического превосходства США над всеми странами мира.

После принятия Конгрессом решения о бюджетном финансировании научно-исследовательской части программы СОИ ($30 млрд.) в рамках соответствующих проектов (в общей сложности около 20) в США развернулась широкая дискуссия среди ученых и инженеров о надежности системы управления ПРО с элементами космического базирования. Ученые в отличие от политиков не подались соблазну искушения создать «противоракетный зонтик» над Америкой, хорошо представляя всю сложность технического воплощения программы, не говоря об опасности размещения лазерного оружия в космосе (рис. 6).

Но протесты ученых и общественности против программы СОИ достигли своей цели только тогда, когда в результате демонстрационных испытаний, проведенных Пентагоном, выявилась недостижимость осуществления поставленной цели в течении ближайших (на тот период времени) 10-15 лет. Основная причина отказа от дорогостоящего проекта заключалась в отсутствии не только готовых, но и ожидаемых конструктивных решений в области информационных технологий, связанных с большими объемами обрабатываемой информации в режиме реального времени.

Так был закрыт один из самых амбициозных и дорогостоящих научно-технических проектов человечества, сопоставимый по своей значимости только с американской программой полетов человека на Луну. Тем не менее «звездные войны», при всей своей фантастичности на грани авантюры, стали подлинным катализатором целого ряда важнейших направлений развития современных технологий, включая суперкомпьютеры.

Криптоанализ и суперкомпьютеры

Было бы несправедливо обойти в истории развития суперкомпьютеров и тот малоизученный, в силу своей глухой и непроницаемой завесы тайны и абсолютной секретности, но крайне важный для интересов национальной безопасности США, раздел прикладной области применения сверхпроизводительных вычислений, которым по праву считается во всем мире криптоанализ. Хотя проблема раскрытия зашифрованного сообщения возникла примерно в одно время с появлением первых шифров – за несколько сот лет до создания первого компьютера – научное обоснование ее решения было сформулировано только после Второй мировой войны в математической теории связи американца Клода Шеннона и нашего соотечественника В.Котельникова.

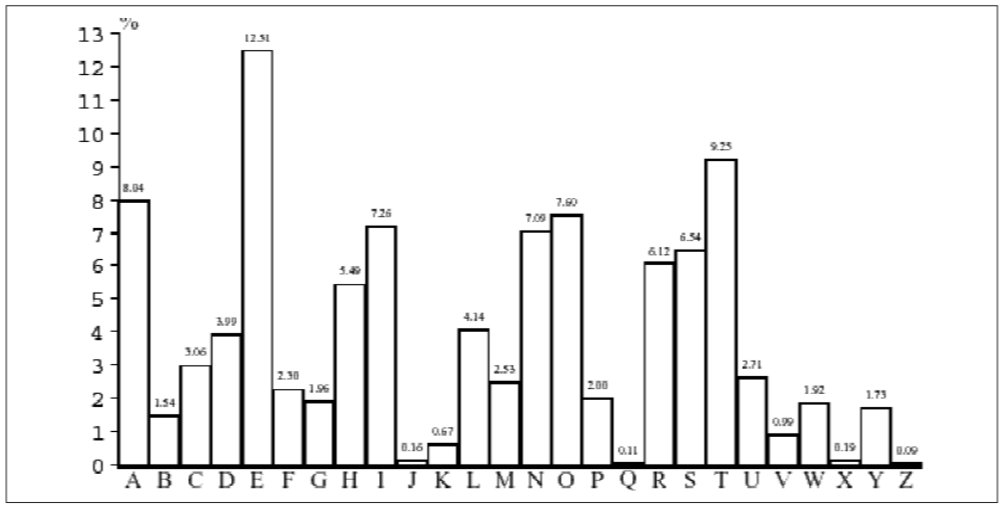

Главной в этих работах является концепция избыточности информации, согласно которой в сообщении содержится больше символов, чем в действительности требуется для его передачи по каналу связи: хорошо известные нам лексические обороты в личных и деловых письмах (дорогая, уважаемый, искренне ваш, целую и т.п.) являются серьезной зацепкой в раскрытии любого шифра. Одновременно Шеннон первым сумел объяснить постоянство частот встречаемости букв и, тем самым, разработал теоретические основы современного криптоанализа: например, в английском языке частота появления буквы E составляет 12,5%, а буквы Z – 0,09%19 (рис 7).

Строго говоря, первый электромеханический компьютер был разработан англичанами для раскрытия немецкого шифра «Энигма» (в переводе на русский – загадка). Руководил этим направлением работ на невидимом фронте один из лучших математиков Великобритании того времени – Алан Тьюринг, в тихом и уединенном месте в пригороде Лондона – Блетчли, а его услугами пользовался никто иной, как премьер-министр Уинстон Черчиль.

Известное всем пристрастие сэра У.Черчиля к дорогим кубинским сигарам, хорошему армянскому коньяку и длительному пребыванию в утренние часы в постели не помешало первому лорду адмиралтейства и заклятому врагу советской власти трезво оценить масштабы угрозы, нависшей над туманным Альбионом после 1 сентября 1939 года. Немецкие подводные лодки и бомбардировщики, по планам Гитлера, получившим название операция «Морской лев»20, должны были блокировать Англию с моря, разрушить ее военно-промышленный потенциал с воздуха и деморализовать население, после чего германскому вермахту оставалось только повторить переправу легионов Цезаря через Ла-Манш и завоевать непокорных англичан. Но немцы ошиблись в своих расчетах, самонадеянно посчитав, что содержание шифрованных телеграмм (до 2 тысяч в сутки) с секретными приказами на потопление морских конвоев из Америки и бомбежки английских городов оставались известными только им. Англичане читали все немецкие шифртелеграммы благодаря находчивости капитана британских ВМС Яна Флеминга – будущего автора книжной эпопеи про подвиги агента 007 – Джеймса Бонда. Флеминг предложил дерзкий план – захватить на тонущей немецкой подводной лодке в Атлантике шифровальную машину и использовать ее для вскрытия замыслов противника.

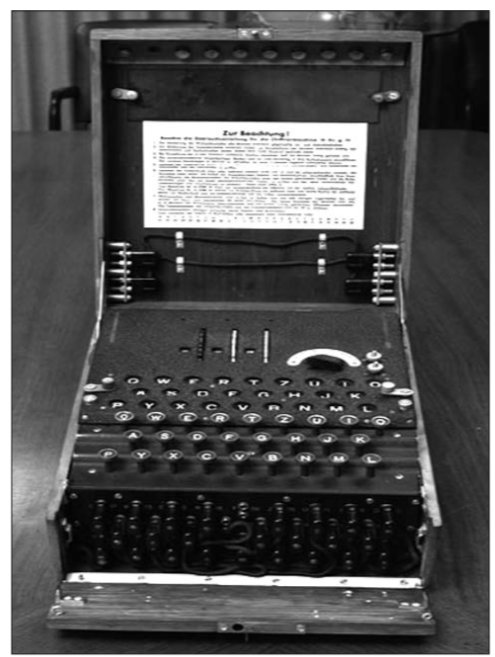

«Энигма» (рис. 8) в первоначальном промышленном варианте фирмы «Сименс», созданном берлинским инженером Артуром Кирхом, представляла собой четыре вращающихся на одной оси барабана, что обеспечивало более миллиона вариантов ключа, которые определялись текущим положением барабанов. На каждой стороне барабана по окружности располагались 26 электрических контактов (сколько букв в алфавите). Контакты с обеих сторон барабана соединялись попарно случайным образом 26 проводами, формировавшими замену символов. Колеса складывались вместе, и их контакты, касаясь друг друга, обеспечивали прохождение электрических импульсов сквозь весь пакет колес21.

При нажатии клавиши и кодировании очередного символа роторный механизм «Энигмы» генерировал для каждого знака открытого текста сообщения уникальную последовательность шифра, который имел теоретически свыше 1026 комбинаций замены.

Но без ключа к своему шифру, в котором использовалась так называемая многоалфавитная система замены22, «Энигма» так и осталась бы загадкой, если бы англичане не построили свой, пусть, несовершенный по современным меркам, но фактически первый электромеханический компьютер «Бомба» для нахождения одной заветной последовательности цифр и букв, открывавшей им планы противника. Тьюринг на основе методов математической статистики и разработанной им теории дискретных автоматов предложил очень изящный и, вместе с тем, весьма эффективный алгоритм криптоанализа, существенно ограничивавший количество комбинаций ключа.

Не последнюю роль в разгадке секрета «Энигмы» сыграли излишняя педантичность и аккуратность немецких радистов, проставлявших в начале телеграмм условные обозначения положения роторов шифровальной машины, что, в сочетании с ежедневными метеосводками для кораблей и самолетов, давало хорошее подспорье англичанам для атаки на шифр противника. Так с помощью математики и прообраза современного компьютера была выиграна битва за Англию, в которой во имя сохранения своей необычной технологии в тайне У.Черчиль был вынужден пожертвовать жизнями сотен обитателей маленького городка Ковентри, подвергшегося варварской бомбардировке немецкой авиации23.

Знаменитый советский разведчик Ким Филби, работавший в это время в британской разведке, с помощью своих товарищей снабжал Красную Армию стратегической информацией, полученной англичанами с помощью «Бомбы». Один из помощников Филби – Джон Кернкросс провел почти год в Блетчли, редактируя расшифрованные машиной Тьюринга материалы «Энигмы». До сих пор историки спорят о том, было ли это хитростью У.Черчиля, передававшего таким образом И.Сталину, как своему союзнику по антигитлеровской коалиции, важную информацию или же величайшим провалом английской разведки во Второй мировой войне. Известно одно – летом 1943 года в ходе сражения под Курском немцы потерпели сокрушительное поражение, переломившее весь последующий ход войны, во многом благодаря информации, своевременно полученной от группы Филби24.

Но не только англичане занимались криптоанализом во время Второй мировой войны, где от одной своевременно расшифрованной кодограммы зависели жизни тысяч людей. В ходе войны с Японией на Тихом океане криптоанализ получил в США мощный стимул для своего развития в прикладное направление математики и теории связи: американцам удалось перехватить и уничтожить над океаном самолет командующего японских ВМС адмирала Ямомомото, выиграть морские сражения в Коралловом море и у атолла Мидуэй.

Результаты криптоанализа в США (как и во всех странах) могут держаться в тайне многие десятилетия в интересах национальной безопасности, а для их раскрытия требуется решение специальной комиссии и личная подпись американского президента. К числу таких рассекреченных работ относится проект «Венона», в ходе которого в течение 1943–1946 гг. американские спецслужбы вели радиоперехват шифрованных сообщений советской разведки в США, сумевшей глубоко проникнуть в тайны атомного проекта «Манхэтэн».

Только совсем недавно стало известно о том, что успех спецслужб США в операции «Венона» во многом был связан с использованием первого лампового компьютера «Эниак» (рис. 9), который по иронии судьбы разрабатывался первоначально для проведения расчетов атомной бомбы, за секретами которой в свою очередь охотилась советская разведка.

Интересно, что по теории Шеннона криптоанализ системы одноразовых шифрблокнотов, которые использовала советская разведка в этот период, теоретически имеет шансы на успех равные нулю при условии регулярной смены ключей и аккуратном обращении с исходным текстом. Американцам просто повезло, когда в их руках оказались шифрблокноты, которые, как выяснилось позже, печатались машинистками преимущественно одной рукой со смещением частот цифр25, отдельные страницы были продублированы и использовались шифровальщиками с грубыми нарушениями и повторяющимися ошибками. Не исключено, что на эту мысль их мог натолкнуть все тот же А. Тьюринг. Некоторые историки считают, что дело супругов Розенбергов, обвиненных в атомном шпионаже в пользу СССР и казненных на электрическом стуле в июне 1953 года, было сфабриковано ФБР для того, чтобы скрыть сам факт раскрытия секрета шифра советской разведки26. А спустя год скоропостижно скончается от отравления всеми гонимый и забытый А.Тьюринг, потерявший к тому времени допуск к секретным работам. Неправда ли, в этом есть какая-то своя фатальная закономерность? Как бы там ни было, но победа американских криптоаналитиков оказалась запоздалой: в августе 1949 г. Советский Союз успешно провел испытание атомного, а всего через год, опередив США, ядерного оружия.

Сегодня криптоанализом, этой трудоемкой и малопонятной для непосвященных, но крайне увлекательной для математиков, лингвистов и программистов задачей, в США занимается специальное ведомство – Агентство национальной безопасности (National Security Agency), штаб-квартира которого размещается в Форт-Миде (шт. Мэриленд), на полпути между Вашингтоном и Балтимором. Основатель первого в истории США «черного кабинета», знаменитый американский криптоаналитик Герберт Ярдли был бы просто поражен той техникой и масштабами слежки за своими согражданами, которыми сегодня обладает АНБ.

Покров таинственности, которым это учреждение окутано с момента своего появления на свет в ноябре 1952 года, существует и в наши дни: лишь в 1957 году в справочник «Правительственные учреждения США» впервые было включено краткое описание агентства, которое «осуществляет в высшей степени специализированные технические и координационные функции, связанные с национальной безопасностью». АНБ, по признанию его бывших сотрудников, «еще более молчаливая, секретная и мрачная организация, чем ЦРУ». Как шутят сами американцы, упоминая в разговорах между собой аббревиатуру агентства: «никому ничего не говори» (Never Say Anything) или «нет такого агентства» (No Such Agency).

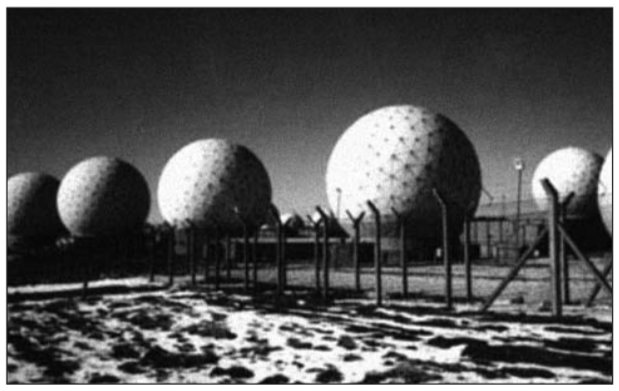

Здесь за прочными и непроницаемыми практически для всех видов электромагнитных и звуковых волн стенами днем и ночью работают над раскрытием чужих государственных, политических, военных, экономических и научно-технических тайн тысячи высококвалифицированных специалистов, собирая, расшифровывая и анализируя информацию, перехваченную специальными постами радиотехнической разведки, разбросанными по всему миру. По официальным данным до 11 сентября 2001 года бюджет АНБ, в штате которого числилось около 35 тысяч человек, составлял величину порядка $5 млрд., в то время как на все программы радиоэлектронного шпионажа тратилось свыше $10 млрд. или примерно одна треть бюджета разведывательного сообщества США27. Одной из таких глобальных систем радиоэлектронной разведки является скандально известный «Эшелон», чуткие уши которого улавливают малейший сигнал в радиоэфире за тысячи километров от берегов США (рис 10).

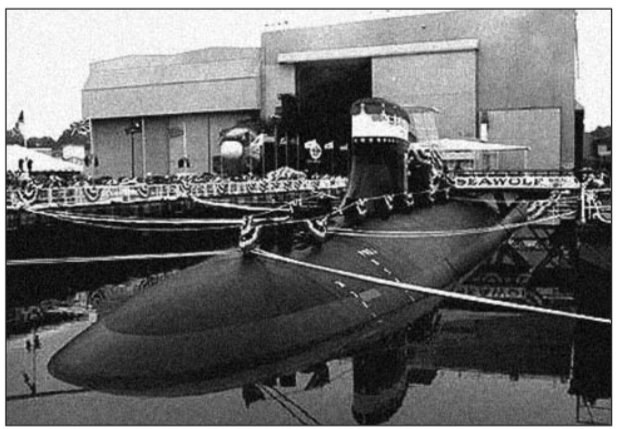

Сейчас в доках судоверфи Норфолка стоит новая малошумная атомная многоцелевая подводная лодка класса «Си вульф» (Морской волк) SSN23 водоизмещением 9 тысяч регистровых тонн, на оснащение которой современной аппаратурой радиотехнической разведки производства компании «Дженерал дайнэмикс» Конгресс США по заказу АНБ выделил почти $1 млрд. Субмарина-шпион, крестником которой стал экс-президент Джимми Картер, будет оснащена специальным глубоководным автономным спускаемым подводным аппаратом для подключения к кабелям связи на дне океана и вступит в боевой состав американского флота в середине 2004 года. Как удастся джентльменам из Форт-Мида незаметно подключиться к волоконнооптическим кабелям бесконтактным способом (без разрыва защитной оболочки и стекловолокна) – автору не известно. Может быть для этого будет использован физический эффект магнито-ядерного резонанса или поток нейтрино? Глава АНБ генерал-лейтенант Хайден и командование ВМС США отказываются комментировать эти технические подробности28, хотя и так понятно – суперлодка могла бы пригодиться АНБ для прослушивания телефонных разговоров и перехвата трафика Интернета накануне событий 11 сентября.

АНБ наряду с ЦРУ, ФБР и другими спецслужбами составляет ядро разведывательного сообщества, выполняя в нем одну из самых важнейших функций – сбор информации с помощью подводных, надводных, наземных, воздушных и космических радиотехнических средств контроля электромагнитных излучений, для обработки которой и используются самые мощные, высокопроизводительные компьютеры в мире. По оценкам зарубежных экспертов, АНБ входит в первую десятку ведущих организаций, связанных с проектами в области высокопроизводительных вычислений. Не случайно один из первых экземпляров суперкомпьютера «Cray-1» появился именно здесь, где джентльмены так любят читать чужие зашифрованные послания. Сегодня этот чудо-компьютер середины 70сх годов 20-го столетия занимает одно из самых почетных мест в экспозиции местного музея, где можно увидеть и более древние экспонаты из истории криптографии и криптоанализа.

Хотя номенклатура, количество и характеристики установленных в этом ведомстве суперкомпьютеров засекречены, специалисты полагают, что их суммарная производительность составляет величину порядка 156 Гфлоп. АНБ принадлежит одна из самых мощных по количеству процессоров (1024) моделей суперЭВМ «Cray-T3D». Принимая во внимание тот факт, что за последние 10 лет общее количество суперкомпьютеров в мире, связанных с секретными проектами (в том числе и в области криптоанализа), по официальной статистике колебалось в пределах от 19 в1 993г.до 46 в 1998г.исоставляет в настоящее время 25 единиц, не трудно оценить в первом приближении количество ЭВМ этого класса и в АНБ, взяв за основу долю США в их общей массе (46%) – 12 ед.

Но ни один компьютер не в силах заменить человеческой интуиции. Вот как выглядит рутинная технология криптоанализа в АНБ, описанная американским журналистом Дэвидом Каном. «Криптоаналитики работают группами. Сложные современные шифры превратили работу одиночки в дело прошлого. Руководитель группы распределяет задания между подчиненными, проводит совещания, решает, является ли данный метод более продуктивным, чем другие. Работа отдельно взятого криптоаналитика в составе группы заключается в отыскании статистически устойчивых и значимых закономерностей (частот, периодов повторений, корреляций и других статистик), которые дают значительные отклонения от случайного текста»29.

Добавим, что даже самый совершенный машинный генератор случайных чисел обладает таким неприятным свойством, как период вырождения, когда через сотни тысяч и даже миллионы итераций он начинает повторять всю последовательность заново, давая криптоаналитикам возможность найти путь к раскрытию шифра. А еще существует так называемый эффект групповой автокорреляции, при котором сочетания букв или цифр периодически также повторяются. И это тоже одна из изюминок криптоанализа30. Поклонников так называемой системы двух ключей или несимметричного шифра хочу разочаровать – найти (за приемлемое время) два больших простых числа, произведение которых лежит в основе шифра Фила Циммермана PGP (Pretty good privacy) на обычном персональном компьютере, ограниченном в быстродействии и разрядности, действительно практически невозможно, но не на суперкомпьютере «Cray-T3D». Всего пару десятилетий назад, на заре криптографии с открытым ключом считалось, что для реализации альтернативного PGP алгоритма RSA достаточно даже 128-битовых чисел. Сейчас эта граница отодвинута до 1024-битовых чисел – практически на порядок – и это далеко еще не предел31.

Но и это еще не все. «Если в Форт-Миде получают несколько экземпляров одного и того же сообщения, перехваченных разными радиостанциями, редакторы пытаются устранить в нем все имеющиеся искажения. Затем осуществляется сравнение и сопоставление местонахождения отправителей и получателей сообщений, маршруты их прохождения и служебные пометки, присутствующие в этих сообщениях для сведения шифровальщиков и операторов связи. Это позволяет отсортировать перехваченные сообщения по принципу принадлежности к одинаковым шифрсистемам. Собранная картина переписки во всей ее полноте позволяет выявить общую структуру сети связи и получить другую полезную информацию»29.

Что и говорить – слишком велик соблазн у любого разведчика, прочитав заметку в газете, зашифровать и передать ее в Центр под видом ценного донесения агента Х: не каждому удается завербовать дипломата или члена парламента – лучше, конечно, шифровальщика.

Анекдотичность подобной жизненной ситуации в работе спецслужб хорошо и убедительно показана Грэмом Грином в его романе «Человеческий фактор», где главный герой – офицер английской разведки Ми-6 – посылает в Лондон секретные чертежи иностранного ядерного центра, скопированные с технического описания ... пылесоса.

К слову сказать, арсенал современной криптографии за последнее время изрядно пополнился, и в моде теперь так называемая стеганография, когда текст открытого сообщения прячется в звуковом, видео или графическом файле. Но все новое – это хорошо забытое старое: еще Геродот описывает хитрость персидского царя Ксеркса, использовавшего в 5 веке до н.э. для этого обритую голову своего раба. В наши дни нет смысла ждать, когда отрастут волосы – проще надеть парик. Во всяком случае специалисты АНБ утверждают, что члены террористической организации Аль-Каида использовали стеганографию для планирования и организации ударов 11 сентября, обмениваясь сообщениями ... через порнографические сайты Интернета33. Может быть поэтому сейчас в США началась такая активная компания борьбы за нравственные устои электронных средств СМИ.

И все же, основной урок, который извлекли для себя обитатели Форт-Мида, впрочем, как и других американских спецслужб, после 11 сентября, заключается в том, что гигантские массивы информации – таинственные и поражающие воображение терабайты, собранные агентурными и техническими методами разведки, нуждаются не только в очень тщательной и скрупулезной обработке, но и ... в своевременном обмене со своими коллегами по разведывательному сообществу в интересах предотвращения террористических актов.

Недаром говорится – дорога ложка к обеду. Как это будет осуществлено на практике – покажет время. Во всяком случае технология многомерного анализа (добычи) данных (data mining), которую сегодня вслед за АНБ взяли на вооружение ЦРУ и ФБР, в сочетании с технологией высокопроизводительных вычислений и Интернетом таят в себе огромные возможности, упустить которые было бы не разумно.

Кроме расшифровки чужой корреспонденции, АНБ разрабатывает рекомендации и стандарты по информационной безопасности и закрытию технических каналов утечки информации в собственной стране, используя для этого богатый опыт охоты за чужими секретами: известно, что в течение длительного времени АНБ перехватывало и расшифровывало секретную информацию почти 120 стран, пользовавшихся оборудованием подставной швейцарской фирмы «Crypto AG»34. Одним из таких стандартов является серия нормативных документов с описанием технических условий эксплуатации радиоэлектронных устройств под аббревиатурой TEMPEST35, полное название которой до сих пор остается секретным. Все компьютеры, на которых обрабатывается информация в высшем эшелоне государственного и военного управления США, имеют защиту от излучения по стандарту TEMPEST. Этот же стандарт используется для защиты важнейших радиоэлектронных систем от электромагнитного импульса, источником которого могут быть атмосферные электрические разряды как естественного (грозового), так и искусственного (от ядерного взрыва) происхождения36.

Решая практические задачи криптоанализа на чужих шифрованных сообщениях, АНБ постоянно совершенствует национальные криптографические алгоритмы, привлекая для этого в открытых конкурсах лучших специалистов во всем мире. Примером такого международного проекта является разработка нового стандарта для так называемой коммерческой криптографии AES (Advanced Encryption Standard), победителем в котором по итогам двух раундов в течение последних четырех лет среди 15 алгоритмов стал блочный симметричный шифр «Рейндален» (RIJNDALEN), авторами которого являются бельгийские математики Винсент Раймен и Джон Даемен. Впервые за всю современную историю криптографии американцы пошли на беспрецедентный шаг, допустив к участию в конкурсе на национальный стандарт иностранных специалистов. Впрочем, в этом нет ничего удивительного, если принять во внимание тот факт, что Бельгия является союзником США по НАТО, и, кроме того, одним из условий конкурса была полная прозрачность алгоритма с точки зрения математических операций, а также отсутствие патента на его изобретение в США: лучшей наградой и рекламой победителям стали отзывы ведущих криптоаналитиков АНБ, проверявших стойкость алгоритма на суперкомпьютерах с использованием специальных математических методов анализа37.

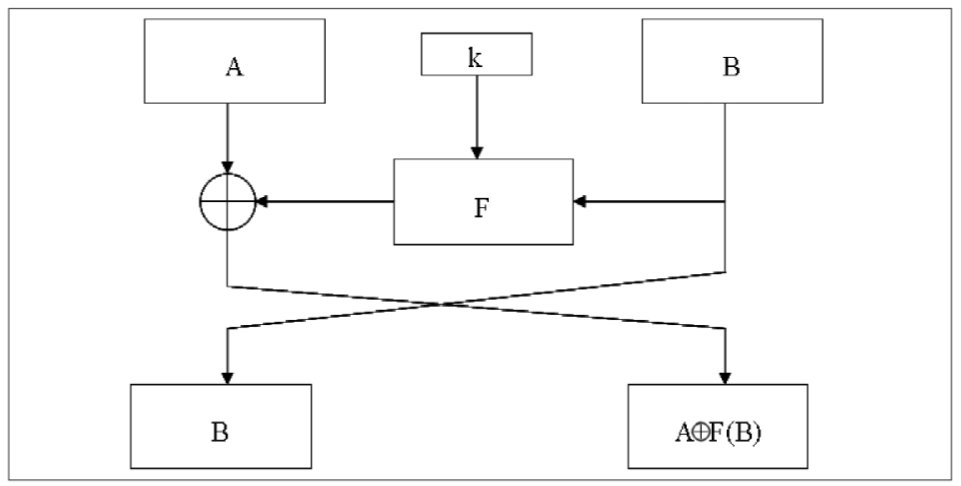

По оценкам экспертов, для вскрытия нового шифра с длиной ключа 256 бит потребуется непрерывная работа самого мощного компьютера в течение времени, превышающего возраст нашей Вселенной (20 млн. лет). Впрочем, в свое время, когда АНБ принимало в качестве национального криптографического стандарта алгоритм DES (патент США No3958081), основанный на так называемых цепях Фейстеля (рис 12), в качестве гарантии его стойкости давалось время последовательного перебора комбинаций ключа длиной 56 бит не менее 100 лет непрерывного машинного счета «Cray-1».

В классической цепи Фейстеля каждый двоичный блок делится на две половины, поочередно «крест-накрест» перемешивая которые и одновременно закрывая одну половину случайными последовательностями бит на основе ключа, за несколько циклов (16 и более) шифруется весь блок информации. Такая схема шифрования информации гарантирует уникальность ключа и целостность блока: в случае несовпадения хотя бы одного бита (ключа или блока) информация в блоке полностью теряется. Во избежании искажений информации при передаче в канале связи используются контрольные проверки на четность38.

Менее чем через четверть века гарантированный специалистами рубеж стойкости алгоритма DES был пройден с помощью Интернета и параллельной обработки данных всего за несколько часов. Но не все шифры так легко и быстро вскрываются. Не так давно ФБР призналось в том, что даже специалистам АНБ понадобилось больше года на расшифровку двух файлов, найденных в компьютере одного из организаторов взрыва в Международном торговом центре в 1993 году. Тогда спецслужбам удалось предотвратить взрывы 11 американских авиалайнеров39. Как любил повторять отец кибернетики Ноберт Винер «любой шифр может быть вскрыт, если только в этом есть настоятельная необходимость и информация, которую предполагается получить, стоит затраченных средств, усилий и времени». Видимо поэтому алгоритмы и программы, реализующие изощренные математические методы атаки на шифры, являются еще более охраняемой тайной, чем сами шифры. История Тьюринга и его машины служит наглядным примером этому.

Вот почему, принимая новый стандарт криптографического алгоритма, AES исключительно в интересах его коммерческого использования (цифровой аудио и видеозаписи, финансовых и биллинговых транзакций и др.)40, АНБ дает гарантию его стойкости (секретности) с поправкой на быстродействие современных суперкомпьютеров, о непрерывно возрастающих возможностях которых речь пойдет впереди.

Пентагон и суперкомпьютеры

Военное ведомство США проявляет завидную и упорную настойчивость в применении суперкомпьютеров, несмотря на свои неудачи в программе СОИ, о которых мы упоминали выше. Опыт боевых действий в Персидском заливе, Югославии, Албании, террористические акты 11 сентября 2001 г. в Нью-Йорке и Вашингтоне, наконец операция по уничтожению баз боевиков Аль-Каиды в Афганистане активно стимулируют новые направления в использовании Пентагоном высокопроизводительных вычислений. За двадцать лет, которые прошли после памятной речи Рональда Рейгана о «звездных войнах», Пентагон вышел на качественно новый уровень в своих НИОКР, связанных с использованием суперкомпьютеров, создав фактически с нуля собственную сеть высокопроизводительных ЭВМ, которая сегодня обслуживает свыше 4 тыс. ученых и инженеров в 100 ведущих американских университетах, исследовательских центрах и лабораториях, занятых в 600 крупных военных проектах.

Сегодня можно с большой долей уверенности говорить о том, что это направление развития информационных технологий, которое в значительной степени повлияло на судьбу СОИ, заставив отказаться от идеи размещения лазерного оружия в космосе, достигло или во всяком случае очень близко к тем рубежам, о которых в начале 80-х годов американские генералы могли только мечтать, просматривая незатейливые анимационные ролики «звездных войн». Непреклонная твердость и решимость американского военно-политического истеблишмента в стремлении создать национальную ПРО с одновременным выходом из договора 1972 г. во многом подкрепляется результатами НИОКР в области высокопроизводительных вычислений, достигнутыми за последние 10 лет.

Развитие технического прогресса по спирали находит свое отражение в новой программе Пентагона создания общенациональной высокоскоростной научно-исследовательской и инженерно-конструкторской сети суперкомпьютеров DREN (Defense Research Engineering Network), которая должна сделать США неоспоримым лидером в практическом применении целого комплекса стратегических технологий, основанных на высокопроизводительных параллельных вычислениях с высокоточной визуализацией объектов и математическим моделированием физических процессов.

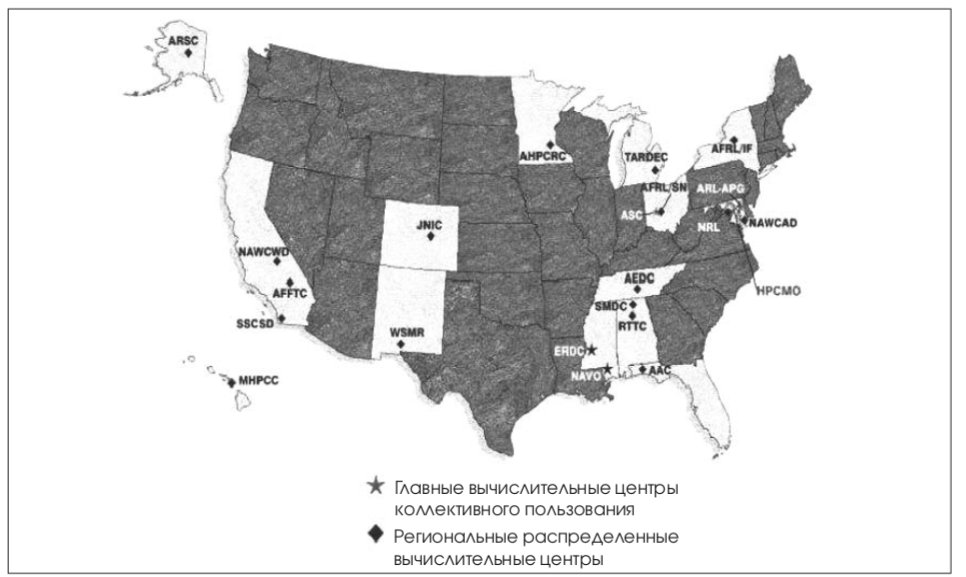

На сегодняшний день высокоскоростная сеть суперкомпьютеров DREN объединяет 4 главных вычислительных центра коллективного пользования и 17 региональных распределенных вычислительных центров, размещенных по всей территории США (см. рис. 13). На ее развитие и модернизацию в период с 1997 по 2007 гг. выделено в общей сложности $1,73 млрд. В составе этой самой мощной в мире сети суперкомпьютеров насчитывается 64 объекта электронно-вычислительной техники (ЭВТ) общей производительностью 12 Тфлоп. При этом 96% всей вычислительной мощности сети DREN сосредоточено в 4 главных вычислительных центрах коллективного пользования: Центре исследования аэрокосмических систем на военновоздушной базе Райт-Паттерсон (шт. Огайо) – ASC41, Исследовательской лаборатории сухопутных войск на полигоне армии США в Абердине (шт. Мэриленд) – ARL-APG, Центре исследований и разработок сухопутных войск в Виксбурге (шт. Миссисипи) – ERDC, Океанографическом управлении ВМС США в Космическом центре им. Джона Стениса (шт. Миссисипи) – NAVO.

Распределенные центры сети DREN, выполняющие роль региональных вычислительных центров, на долю которых приходится до 75% всех проектов Пентагона в области высокопроизводительных вычислений, включают в себя: Центр авиационных систем вооружения ВВС США на авиабазе в Эглин (шт. Флорида) – AAC, Испытательный центр ВВС США на авиабазе Эдвардс (шт. Калифорния) – AFFTC, Исследовательская лаборатория ВВС США в Риме (шт. Нью-Йорк) – AFRL/IF, Исследовательская лаборатория ВВС США на авиабазе Райт-Паттерсон (шт. Огайо) – AFRL/SN, Вычислительный центр арктического региона в Фэйрбэнкс (шт. Аляска) – ARSC, Исследовательский центр высокопроизводительных вычислений сухопутных войск США в Минеаполисе (шт. Минесота) – AHPCRC, Центр инженерных разработок на авиабазе Арнольд (шт. Теннеси) – AEDC, Национальный объединенный центр интеграции на авиабазе Шривер (шт. Колорадо) – JNIC, Центр высокопроизводительных вычислений в Мауи (шт. Гавайи) – MHPCC, Центр воздушной войны ВМС США в Патаксен-Ривер (шт. Мэриленд) – NAWCAD, Центр воздушной войны ВМС США в Чайна-Лейк (шт. Калифорния) – NAWCWD, Исследовательская лаборатория ВМС США в Вашингтоне (федеральный округ Колумбия) – NRL, Технический испытательный центр арсенала в Редстоун (шт. Алабама) – RTTC, Штаб командования космических сил и противоракетной обороны в Хантсвилле (шт. Алабама) – SMDC, Космический центр ВМС США в Сан-Диего (шт. Калифорния) – SSCSD, Центр исследований и разработок бронетанковой техники в Уоррен (шт. Мичиган) – TARDEC, Ракетный полигон в Уайт-Сэндс (шт. Нью-Мексика) – WSMR.

География размещения вычислительных центров сети DREN говорит сама за себя – охват значительной территории континентальной и островной части США (13 штатов и один федеральный округ) обеспечивает глобальный доступ к ее ресурсам в любое время суток с максимальной загрузкой вычислительных мощностей четырех главных центров коллективного пользования. Как тут не вспомнить, что сами США, как независимое государство, 226 лет тому назад создавались на основе все той же магической цифры – 13 штатов. Удаленный доступ к ресурсам сети DREN осуществляется по высокоскоростным каналам передачи данных со скоростьюдо1,5Гбитвс.(к2004г.до10Гбитвс.).Пользователями сети могут быть как военные, так и гражданские научно-исследовательские организации и университеты штатов (Алабама, Вирджиния, Гавайи, Джорджия, Иллинойс, Калифорния, Миссисипи, Мичиган, Мэриленд, Огайо, Пенсильвания, Северная Каролина, Теннеси, Техас, Флорида), участвующие в совместных проектах в области высокопроизводительных вычислений.

С этой целью Пентагон выдвинул достаточно смелую, с точки зрения военной бюрократии, и революционную в технологическом отношении инициативу, получившую название «Единой поддержки программного обеспечения высокопроизводительных вычислений» (Common High Performance Computing Software Support Initiative)42.

Суть этой инициативы заключается в доступе пользователей не только к вычислительным ресурсам центров (процессорам, каналам, оперативной и внешней памяти), но и алгоритмам, их программной реализации. Характерно, что 97% прикладного программного обеспечения для суперкомпьютеров на сегодняшний день написано на современных версиях классического Фортрана (77, 90, HPF), хорошо известная и непревзойденная математическая мощность которого при решении задач численными методами (линейные и дифференциальные уравнения, преобразование Фурье и др.) в сочетании с практически неограниченными возможностями в области системного программирования языка Си++ позволяют быстро разрабатывать полноценные приложения с удобным для пользователя графическим интерфейсом43.

Особое место в этой инициативе занимают вопросы информационной безопасности44, связанные с распределенным доступом к вычислительным ресурсам и программам сети DREN. Подарив человечеству Интернет, как открытый для неограниченного общего пользования информационный и коммуникационный ресурс, американцы зорко и бдительно охраняют от посторонних свою сеть суперкомпьютеров – основу своего военно-стратегического и научно-технического потенциала в 21ом столетии. Предусмотрены как несекретные, так и секретные анклавы ресурсов и пользователей сети45. Создана единая распределенная по всем объектам сети система датчиков обнаружения несанкционированного вторжения NIDS, монтирование и испытание которой проводилось под непосредственным наблюдением и контролем со стороны специалистов АНБ. При этом особое внимание уделено высокоскоростному трафику в режиме ATM, надзор за которым осуществляется круглосуточно специальной группой немедленного реагирования. Кроме того, в плановом порядке Управление информационных систем Пентагона осуществляет так называемый аудит информационных ресурсов сети DREN и консультации персонала по предотвращению как перегрузки ресурсов, так и несанкционированного вторжения. На 2002 год запланирован 41 высокоприоритетный проект в области высокопроизводительных вычислений в 9-ти областях исследований, между которыми, в соответствии с установленным регламентом, распределены 25% вычислительных мощностей 4-х главных центров коллективного пользования.

Суперкомпьютеры в эпоху информационных войн и клонирования живых организмов

Интерес американских военных к суперкомпьютерам связан, прежде всего, с созданием новых видов вооружения или, как их еще называют, систем оружия 21-го века: бесшумных подводных лодок, самолетов-невидимок, беспилотных воздушных разведчиков, всепогодных вертолетов огневой поддержки, боевых машин пехоты, авиационных бомб с лазерной системой наведения, крылатых ракет, самонаводящихся артиллерийских снарядов, проникающих в глубь земли боеприпасов, частотного оружия. Все эти и многие другие виды вооружения, оснащенные бортовыми компьютерами, навигационными и радиолокационными средствами46, являются сложнейшими техническими системами, для испытания которых в полигонных условиях требуются большие капиталовложения в инфраструктуру, финансовые затраты, а самое главное – время. Жизненный цикл таких систем от испытаний опытного образца до принятия на вооружение, последующей модернизации и снятия с вооружения постоянно увеличивается и достигает в настоящее время от 10 до 15 лет. Вот почему время для проведения полигонных испытаний и получения статистически надежных данных о тактико-технических характеристиках этих дорогостоящих систем является одним из самых серьезных ограничений, накладываемых на процесс их разработки и модернизации.

Особое значение для проведения испытаний имеют условия натурных экспериментов, параметры которых зачастую не могут быть выдержаны в силу вредного воздействия последствий испытаний на окружающую среду, соблюдения мер безопасности и режима секретности, трудности многократного воспроизведения, нестабильности внешней среды. Это обстоятельство вынуждает ученых и инженеров все чаще отказываться от проведения полномасштабных натурных экспериментов и заменять их, по мере возможности, вычислительными экспериментами, основанными на математическом моделировании с использованием суперкомпьютеров.

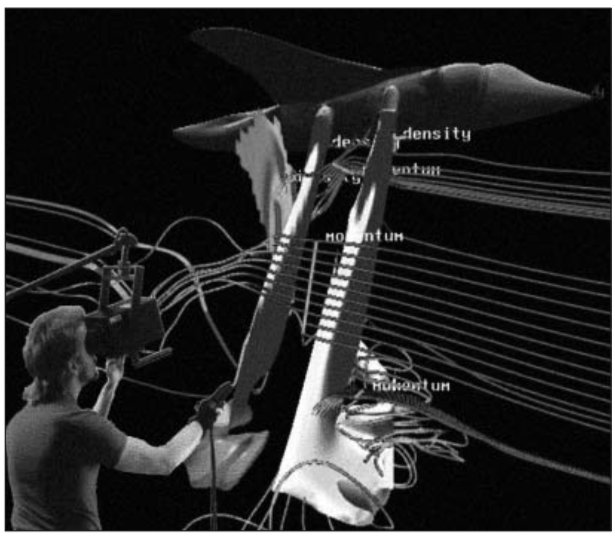

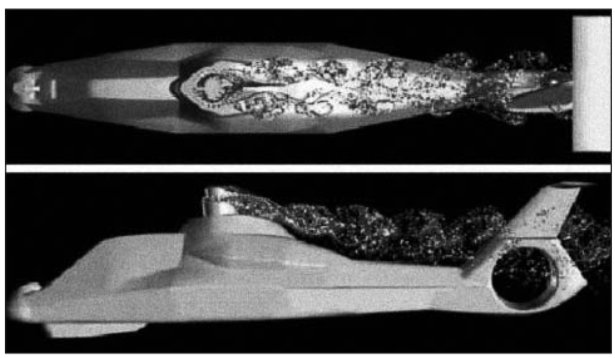

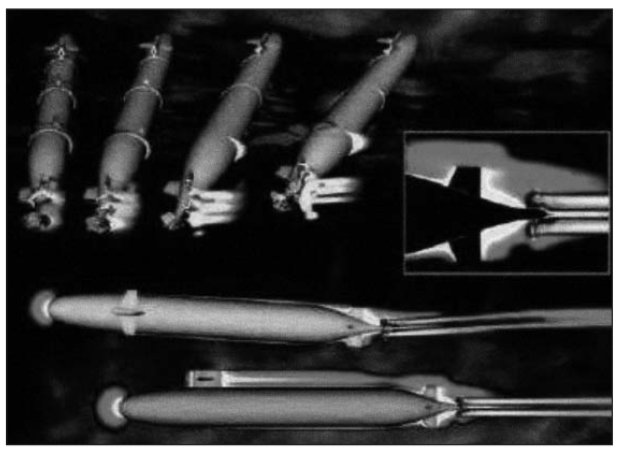

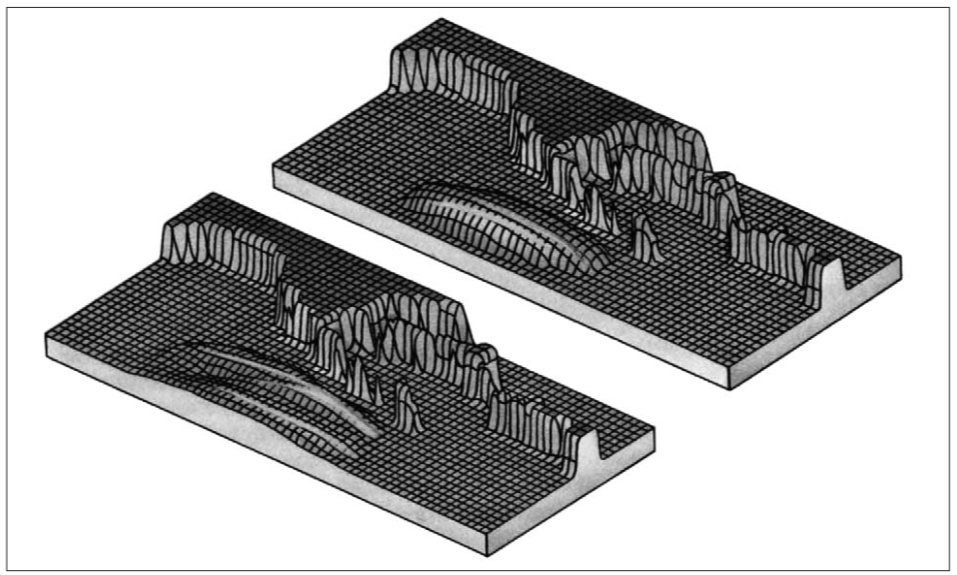

Например, испытание современного сверхзвукового летательного аппарата в аэродинамической трубе не дает полной картины обтекания воздушного потока планера. Существует лишь частичное подобие между экспериментом в трубе и реальным полетом. Расчет сложной аэродинамики ламинарных течений на ЭВМ с использованием математического моделирования позволяет сократить продолжительность испытаний и улучшить технические характеристики изделий, в частности, расход топлива (рис 14). В отличие от экспериментальных установок потенциал математического моделирования (модели, алгоритмы, программы), накопленный при исследовании одного круга задач (например, аэродинамики планера самолета или фюзеляжа вертолета), может быть гибко и быстро применен к решению других проблем (например, гидродинамики подводной лодки) (рис. 15, 16).

Чтобы глубоко понимать работу термоядерного оружия, нужно знать, как ведут себя отдельные части боеголовки при подрыве и вещество в целом в экстремальных условиях: при нагревании до десятков миллионов градусов, при сжатии до тысячи граммов в кубическом сантиметре и т.д. Для этого необходимо просвечивать боезаряды насквозь и непрерывно наблюдать, как начинается взрыв, идет ударная волна, разлетаются оболочки (рис. 17). Моделировать такие процессы можно только либо на мощных лазерных установках в очень маленьких объемах, либо с помощью суперкомпьютеров, что в настоящее время и делают американские ученые в Национальной Ливерморской лаборатории, изучая не только физику ядерного взрыва, но и процессы, связанные с длительным хранением ядерного оружия, а также их влияние на изменение ТТХ боеприпасов. Тем самым, вычислительный эксперимент дает возможность достаточно надежно определять сроки снятия ядерных боеголовок с вооружения без проведения дорогостоящих подземных испытаний, запрещенных действующим в настоящее время соглашением между Россией и США. Для сравнения, отечественная установка «Искра-5» (далеко не самая крупная в мире) занимает большое четырехэтажное здание, и всю свою энергию получает от 12 мощнейших лазерных каналов с диаметром около метра, которая фокусируется в камере объемом около кубического миллиметра47.

Совершенствуя численные методы, ученые решают все более сложные задачи. Прогресс в этой области ничуть не менее важен, чем прогресс в области вычислительной техники. К началу 90-х годов стоимость расчета двумерных моделей течений вязкого газа на ЭВМ одного и того же типа за 15 лет уменьшилась почти в 1000 раз за счет улучшения алгоритмов. Уменьшение за счет только мощности компьютеров составило 100. Хотя суммарный выигрыш стоимости дается произведением обеих величин, удельный вес алгоритма в компьютерных экспериментах более чем очевиден48.

Но и сам по себе вычислительный эксперимент не остается в долгу. Его постоянно возрастающие запросы порождают новые не менее сложные задачи, оказывают плодотворное влияние на математическую физику, теорию дифференциальных уравнений, математическую статистику и математическую логику, многие другие области фундаментальных теоретических и прикладных исследований. В последние годы ряд Нобелевских премий по физике, химии, медицине, экономике присужден работам, методологическую основу которых составляет математическое моделирование. Расшифрованный код ДНК стал результатом плодотворного симбиоза многолетних работ в области генной инженерии, прикладной математики и суперкомпьютерных технологий, сделав реальностью клонирование не только клеток, но и самих живых организмов. Ученые совершили открытие, которое может в будущем спасти жизни тысячам людей.

Суперкомпьютеры и моделирование климата

Всех нас интересует прогноз погоды, и порой мы испытываем большие неудобства от его недостоверности, ругая на чем свет стоит метеослужбу – опять компьютер ошибся. Но можно ли точно прогнозировать климат на Земле? Вопрос этот далеко не праздный, учитывая потрясшие Европу, Россию и Китай в 2002 году наводнения, смерчи и ураганы, материальный ущерб от которых оценивается в десятки $млрд., не говоря уже о человеческих жертвах взбунтовавшейся стихии.

В конце марта 1985 года произошло загадочное исчезновение советского ученого, находившегося в Испании в качестве участника международного симпозиума по проблемам моделирования климата. История эта, походившая на классический шпионский детектив, не получила широкой огласки по ряду причин. Прежде всего, пропавший 46-ти летний Владимир Александров к тому времени получил официальный отказ на въезд в США, где он до этого уже успел побывать несколько раз в качестве эксперта и даже поработать в течение нескольких месяцев в одной из ведущих научных лабораторий49. Кроме того, представители советской дипломатической миссии в Мадриде не проявили, как это принято в таких случаях, повышенного интереса к судьбе своего соотечественника, а испанская полиция не проводила расследования по факту исчезновения иностранного поданного. Люди, хорошо знавшие ученого как жизнерадостного, активного и целеустремленного человека, буквально за несколько дней до его исчезновения почувствовали разительную перемену не только в его поведении, но и в самом внешнем облике пропавшего доктора наук. По словам очевидцев «он был в прострации и сильном опьянении, его как будто подменили»50. Это тем более настораживает, если вспомнить о том, что моральный облик советских граждан, и тем более ученых, находившихся за рубежом, всегда был предметом особого внимания. Чем же занимался Владимир Александров в СССР и США, и почему его столь таинственное исчезновение в Испании не нашло никакого отклика ни у одной из сторон?

В начале 80-х годов, мы уже упоминали об этом, военно-политическое противостояние Восток-Запад достигло своего апогея: угроза глобальной ядерной войны между СССР и США, обвинявших друг друга в наращивании своего военного потенциала, стала реальной на столько, что по обе стороны океана днем и ночью сверхмощные компьютеры проигрывали обмены ракетно-ядерными ударами, подбирая оптимальные варианты уничтожения крупных административно-промышленных и военных объектов двух сверхдержав51.

Решение американского руководства начать НИОКР по программе «звездных войн» с целью изучения возможности развертывания лазерного оружия в космосе для уничтожения ракет противника, первые испытательные полеты транспортной космической системы многоразового пользования «Шаттл» и новых межконтинентальных баллистических ракет «МХ» и «Трайдент» лишний раз убеждали советское руководство в реальности подготовки американцев не только к «ограниченной», но и «затяжной» ядерной войне52. В ответ на размещение модернизированных баллистических ракет средней дальности «Першинг-2» в Европе, откуда они могли в течение 7 минут долететь до Москвы, у берегов США появились советские атомные подводные лодки, готовые в любую минуту нанести быстрый и сокрушительный ответный удар.

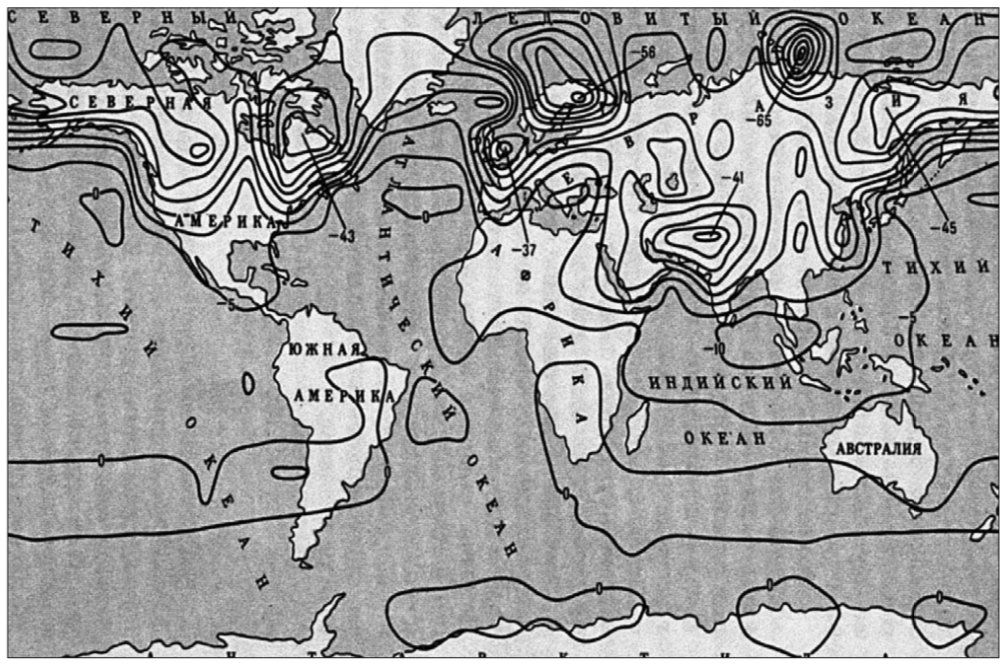

Между тем, в Советском Союзе группа ученых во главе с академиком Н.Моисеевым, среди которых был и Владимир Александров, в инициативном порядке разработала первую в мировой практике математическую модель теплового баланса воздушных и океанских масс – «Гея» и использовала ее для определения губительных последствий глобальной ядерной войны для климата планеты.

Сама идея подобных расчетов была выдвинута американским астрономом Карлом Саганом, выразившим серьезную озабоченность возможными последствиями сильных лесных пожаров в результате обмена ядерными ударами между СССР и США. Результаты трудоемких многодневных расчетов, проведенные в Вычислительном центре Академии наук летом 1983 года на отечественном суперкомпьютере БЭСМ-6, ошеломили даже прагматичных математиков, для которых мегатонны ядерных боезарядов равномерно взорванных над поверхностью земного шара в этот момент не ассоциировались с миллионами человеческих жизней: ученых интересовало распределение средней температуры поверхности мирового океана и атмосферы Земли.

Динамика теплового баланса воздушных и океанских масс, просчитанная на модели с упреждением на несколько месяцев вперед после обмена ядерными ударами, красноречиво свидетельствовала о том, что планету ожидает катастрофа: пылевые облака закроют доступ солнечным лучам, температура в приземных слоях атмосферы понизится, а на высоте горных ледников, наоборот, сильно возрастет, что вызовет наводнения континентального масштаба, океан из-за своей большой теплоемкости будет остывать гораздо медленнее, на фоне контраста температур сильно изменится направление циркуляции воздушных масс, средняя температура воздуха понизится на несколько десятков градусов, снег и град с радиоактивными осадками накроют привычные к теплу экваториальные широты, Европа покроется толстым слоем льда и пепла (рис 18). Иными словами, тепловая машина Земли, как ее называют физики, работающая на принципах классической термодинамики, не выдержит такого мощного однократного выделения ядерной энергии, нарушит свой устоявшийся миллионами лет режим работы и начнет работать как ... холодильная установка53.

Вот эти результаты, получившие в США название эффекта «ядерной ночи», а в СССР – «ядерной зимы» и озвучил молодой доктор физмат наук Владимир Александров на симпозиуме в Испании, где о нем уже к тому времени знали как об ученом с мировым именем. В октябре 1983 г. в Вашингтоне состоялась научная конференция, посвященная оценке последствий возможной ядерной войны. На ней с докладами выступили К. Саган54 и В. В. Александров, изложивший модель, технику ее анализа и результаты расчетов55.

Существенно, что американцы смогли сделать анализ возможной динамики атмосферных изменений лишь для первого месяца после обмена ядерными ударами, а коллектив ВЦ АН СССР смог дать картину целого года. Американцы имели более совершенную модель динамики атмосферы, но она не была состыкована с моделью динамики океана. В работе ВЦ АН СССР модели были проще, но объединены в целостную систему. Их оказалось достаточно для выявления того фундаментального факта, что в результате ядерной войны произойдут такие качественные изменения биосферы, которые исключат возможность жизни на Земле человека56.

Отладку системы моделей В. В. Александров провел в течение восьми месяцев в США в центре климатологических исследований. Для этого руководитель американской климатологической программы профессор Бирли выделил необходимые средства, включая допуск советского ученого к самому мощному суперкомпьютеру того времени – «Cray-XMP». Так в руках американцев оказался ключ к первой в мировой практике математической модели взаимодействия океана и атмосферы, а советская наука понесла очередную, невосполнимую утрату.

Большинство зарубежных и отечественных ученых склоняются к мысли о том, что исчезновение В.Александрова было выгодно, прежде всего, спецслужбам, выполнявшим заказ военно-промышленного комплекса: слишком большой шум был поднят в прессе, последствия которого, в конечном итоге, под нажимом мировой общественности привели ко встрече в Рейкъявике весной 1986 г. Михаила Горбачева и Рональда Рейгана, положившей конец безумной ядерной гонке. Доктор В.Александров – автор уникальной математической модели, человек, доказавший с помощью суперкомпьютера губительные последствия ядерной войны для планеты, оказался в положении гонимого пророка, изгоя по обе стороны океана, и бесследно исчез на темных улицах Мадрида.

Интересно, что град, внезапно обрушившийся на Испанию в августе 2002 г., снег, выпавший в сентябре в Германии, шквальные ливни и наводнение в Европе, смерчи на юге России, сход ледника в горах Северной Осетии – все тот же закономерный результат математического баланса тепловой энергии воздушных и океанских масс, впервые рассчитанного нашим ученым.

В Национальном аэрокосмическом агентстве США НАСА установлены высокопроизводительные 1024-х и 512-ти процессорные системы, являющиеся плодом совместных усилий НАСА и компании Silicon Graphics. Суперкомпьютеры используются учеными для оценки влияния природных явлений и деятельности человека на планетарный климат, а также для прогнозирования его изменений. На новых системах геофизические приложения выполняются в несколько раз быстрее, чем на ранее применявшихся: проект, связанный с моделированием климатических изменений, на который ранее ушло бы шесть месяцев, удалось завершить всего за два.

Национальный центр атмосферных исследований выбрал компанию IBM для установки самого мощного суперкомпьютера, который когда-либо использовался в интересах прогнозирования климата на планете. Компьютер, получивший условное название «Голубое небо» (Blue Sky), будет полностью смонтирован к концу 2002 г. на основе многопроцессорной вычислительной системы, которая по оценкам специалистов должна иметь пиковое значение производительности до 7 Тфлоп и внешней памятью объемом 31,5 Тбайт. С помощью сверхмощного суперкомпьютера ученые на основе математического моделирования смогут оценивать влияние глобальных и региональных изменений климата, а так же засухи, вихревых потоков воздуха, лесных пожаров, химического состава атмосферы и других факторов на продолжительность времени созревания урожая, смещение поясов урожайности, распределение низких температур и уровней осадков в зимнее время.

Компьютеры, произведенные IBM, входят в число 500 самых мощных суперкомпьютеров в мире, учет которых ведут американский университет шт. Теннеси и немецкий университет г. Мангейм. О высоком рейтинге IBM в классе суперкомпьютеров говорит тот факт, что 225 позиций в этом списке занимают ее машины, среди которых в первую пятерку входят такие известные гиганты как ASCI White (Национальная лаборатория Лоуренса Ливермора) и DeepBlue, обыгравший в 1997 г. чемпиона мира Г.Каспарова.

Приведем только некоторые характеристики суперЭВМ ASCI White – одного из самых засекреченных компьютеров в мире, вычислительные мощности которого используются в интересах американской программы технической модернизации и безопасного хранения ядерного оружия.

Пиковая производительность флагмана американской и мировой суперкомпьютерной индустрии на сегодняшний день составляет 12,3 Тфлоп и превышает суммарную пиковую производительность всех четырех главных вычислительных центров коллективного пользования сети DREN. В состав вычислительной системы входят 8192 процессора серии RS6000 SP Power, работающих на частоте 375 Мгц. Емкость оперативной памяти суперЭВМ составляет 6 Тбайт, а внешней – 160 Тбайт, что позволяет хранить информацию 6 библиотек Конгресса США. Вся система размещается почти в 200 шкафах-стойках в помещении площадью равной двум баскетбольным площадкам. Вес оборудования достигает 106 тонн. К 2005 г. эта система будет иметь пиковую производительность в 100 Тфлоп.

Компания IBM является также лидером по суммарной производительности всех своих суперкомпьютеров, которая в настоящее время составляет величину порядка 49 Тфлоп.

Суперкомпьютеры в университетах

Университет шт. Флорида закупил для своих студентов, обучающихся на факультете вычислительной техники и информационных технологий, суперкомпьютер фирмы IBM стоимостью $8 млн. Модель RS/6000 SP обладает теоретической пиковой производительностью до 2,5 Тфлоп. Для того, чтобы выполнить такой объем вычислений в ручную на простом калькуляторе человеку понадобиться 2 млн. лет. После окончательной сборки к концу 2001 г. вычислительная система объединила 680 микропроцессоров на медной шине данных с высокой электрической проводимостью. Для хранения данных суперкомпьютер оснащен внешним накопителем объемом до 413 Тбайт.

Среди научно-исследовательских проектов, в которых предполагается использовать данный суперкомпьютер, можно выделить как наиболее значимые: прогнозирование ураганов и торнадо, анализ кодов ДНК, создание компьютеров и робототехнических устройств, адаптирующихся к условиям внешней среды на основе искусственного интеллекта, управление воздушным движением и телекоммуникационным трафиком, прогноз рынка и выработка стратегий минимального риска и др.

Факультет вычислительной техники и информационных технологий, образованный в 1999 г., готовит специалистов следующего поколения, которых будут отличать глубокие знания прикладных методов вычислительной математики, практические навыки в проведении междисциплинарных системных исследований в таких областях как физика, биология, климатология, гидрология и материаловедение с помощью вычислительных экспериментов на суперкомпьютерах. Учитывая особенности климата шт. Флорида, не трудно понять заинтересованность местных властей, предпринимателей и жителей в исследованиях, связанных с прогнозированием ураганов и наводнений, а также их последствиями для работы воздушного и наземного транспорта, энергетической системы, водопроводной сети, телекоммуникаций, которые постоянно подвергаются ударам стихии со стороны Атлантического океана и Мексиканского залива57.

В другом штате, расположенном за тысячи миль от континентальной части США, на живописных Гавайских островах студенты и аспиранты местного университета исследуют с помощью суперкомпьютера строение и динамику воздушных масс Тихого океана, постигая тайны зарождения гигантских ураганов, опустошительных смерчей и грозных цунами – в переводе с японского «больших волн в гавани», главной причиной образования которых являются подводные землетрясения.

Скорость цунами для Тихого океана со средней глубиной землетрясения 4 км составляет величину порядка 700 км/ч. Даже если источник сейсмических колебаний находится далеко, времени для размышлений остается мало. При этом плотность кинетической энергии волны убывает по минимальному закону – обратно пропорционально квадратному корню из расстояния. Полная энергия цунами практически не уменьшается и может составить до 10% от энергии землетрясения.

До применения суперкомпьютеров для моделирования цунами сейсмический прогноз оправдывался лишь в 5% случаев. Учитывая, что ложные тревоги помимо больших экономических затрат, связанных с эвакуацией населения, рождают и недоверие к ним, не трудно понять важность этой проблемы и в психологическом аспекте: чилийское цунами 1960 г. послужили причиной гибели свыше 60 человек из числа тех 15% жителей г. Хило на Гавайях, которые игнорировали объявленную тревогу.

Кроме сейсмического метода регистрации в принципе возможны и другие (например, аэрокосмическая съемка). Тем не менее выделить в открытом океане волну длиной десятки и сотни километров, а высотой всего лишь один-два метра практически невозможно. Только на походе к береговой черте цунами обнаруживает себя, тормозя, набирая высоту и концентрируя энергию, распределенную ранее на огромной площади.

Вот почему так необходим оперативный и долгосрочный прогноз активности цунами в динамике. Такой основой служит математическое моделирование с высокоточной визуализацией на основе вычислительного эксперимента. После немалых трудов ученые подошли к решению этой проблемы, разработав экономичные вычислительные алгоритмы и комплексы программ, с помощью которых можно быстро проследить на математической модели за развитием цунами от места зарождения до прибрежной зоны (рис. 19). Математические модели и методики расчетов калибруются с помощью восстановления картины развития типичных по условиям возбуждения реальных цунами. Так вычислительный эксперимент с математической моделью на суперкомпьютере позволяет оперативно и достаточно надежно предупреждать об опасности население островов в Тихом океане58.

Серьезную проблему для климата Земли представляет эффект тихоокеaнского течения «Эль-Ниньо» – «Млaденец Христос», который также в последние годы в США активно изучают с помощью вычислительных экспериментов на суперкомпьютерах. Феномен «Эль-Ниньо» заключается в резком повышении температуры (на 5-9о С) поверхностного слоя воды на востоке Тихого океана (в тропической и центральной частях) на площади порядка 107 км2. Предварительная оценка энергии, выбрасываемой океаном в атмосферу в районе действия «Эль-Ниньо» за сутки, составляет величину порядка 4,3·1021 Дж, что соизмеримо с энергией всей атмосферы ~1022 Дж. Полученные результаты моделирования взаимодействия океана и атмосферы позволяют прийти к заключению, что энергия «Эль-Ниньо» в состоянии привести к возмущениям всю атмосферу Земли, что и приводит к экологическим катастрофам, имеющим место в последние годы: засухам, пожарам, ливневым дождям, вызывающим затопление огромных территорий густонаселенных районов, что приводит к гибели людей и уничтожению скота и урожая в разных районах Земли. Природный феномен «Эль-Ниньо» оказывает заметное влияние и на состояние мировой экономики. По данным американских специалистов в 1982–83гг. экономический ущерб от его последствий составил $13 млрд.59.

В университете шт. Гавайи, своеобразной Мекке высокопроизводительных вычислений, установлен один из самых известных в мире компьютеров IBM – знаменитый «Голубой Гавайи», чей предшественник – «Deep Blue» обыграл в 1997 г. чемпиона мира по шахматам Гарри Каспарова, бросившего вызов не столько машинному разуму, сколько параллельной архитектуре суперкомпьютера, в арсенале которой сегодня насчитывается 32 процессора серии Power-2, 16 Гбайт оперативной и 493 Гбайт внешней памяти.

Суперкомпьютеры и космические исследования

17 июня 2002 года американскими астрономами, работающими в рамках проекта LINEAR (Lincoln Laboratory Near Earth Asteroid Research) был обнаружен новый астероид, орбита которого пересекает орбиту Земли. Новый астероид, получивший в НАСА обозначение 2002 MN, имеет диаметр всего лишь 100 метров.

После вычисления его орбиты, оказалось, что за 3 дня до своего открытия он пролетел на расстоянии всего в 120 тысяч километров от Земли, что примерно в 3 раза меньше расстояния до Луны. Именно это расстояние выбрано в НАСА в качестве критического параметра орбиты опасных космических тел.