Знали ли вы, что первый китайский фестиваль (или конвент) научной фантастики был проведен только в 2007 году? Дело в том, что в Поднебесной фантастику признали как литературный жанр только после того, как китайская делегация посетила крупнейшие американские технологические компании и пообщалась с работавшими там инженерами. Оказалось, большинство изобретателей, которые создали наше настоящее, в детстве взахлеб читали научную фантастику. И сегодня китайский писатель Лю Цысинь получает литературные награды «Небьюла» и «Хьюго» за свои произведения, а китайские смартфоны уверенно конкурируют с собратьями, рожденными в Купертино. Потому-то не будем в очередной раз повторяться и изучать существующие идеи и решения в области кибербезопасности, а позволим себе немного пофантазировать. И пусть из этих фантазий родится будущее.

Слово «робот» в 1920 году ввел в обиход чешский писатель Карел Чапек. В его пьесе «R.U.R.» искусственные люди, созданные для выполнения рутинной работы, в конце концов обрели интеллект и свергли человечество, почти полностью заменив его на Земле.

В последующую сотню лет искусственный разум сильно эволюционировал не только на страницах книг и в кинофильмах, но и в реальной жизни. Беспилотные автомобили можно встретить уже не только на городских холмах Сан-Франциско, но и на испытательных полигонах в Москве.

Трудится искусственный интеллект и в сфере кибербезопасности. Амбициозный стартап Cylance который год учит машину отделять вредоносный код от безвредного и добивается при этом значительных успехов. Публичные результаты работы пока не позволяют предположить, что машины смогут заменить существующие антивирусные решения и «песочницы», но они обнадеживают и покупающие Cylance компании, и инвесторов. Американская Avata Intelligence предоставляет в аренду различным организациям систему искусственного интеллекта AVA (и тут уже хочется провести параллель с фильмом «Ex Machina») для помощи в принятии сложных решений и планировании операционной деятельности. AVA учится и работает на примерах и ситуациях не только из сферы кибербезопасности, но и из области общественной безопасности, страхования и даже защиты живой природы.

Можно представлять себе сколько угодно вариантов развития будущего, но, исключая разве что постапокалиптические, все их будет объединять одно: данных со временем будет становиться только больше, а контекст по ним будет все глубже и разветвленнее. Уже сейчас искусственный интеллект помогает справляться с задачами сбора, сортировки и выборки нужной информации из больших массивов данных. Предсказание или, скорее, предугадывание инцидентов кибербезопасности — это та цель, к которой стремятся технологии аналитики действий пользователей и сущностей — User and Entity Behavior Analytics. Неизвестно, придем ли мы в итоге к реальности, показанной в «Особом мнении», но ситуация, когда информация о еще не совершенном инциденте заблаговременно предоставляется CISO или штабу SOC, уже не кажется абсолютно фантастической и невозможной.

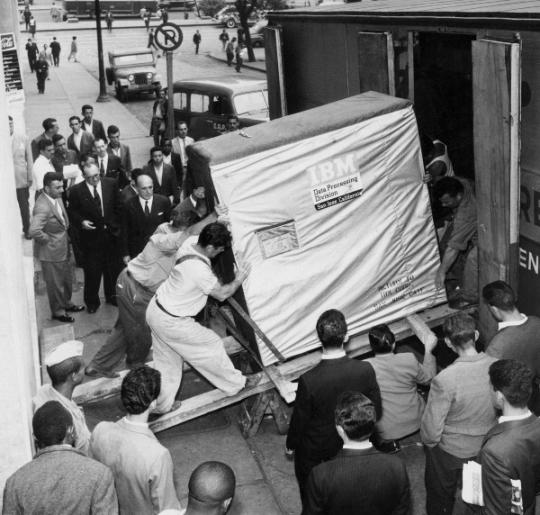

Сегодня системы защиты умеют собирать терабайты информации о поведении пользователя, программного обеспечения, а также о самих рабочих станциях и серверах. Аккумулировать эту информацию в суперхранилище, проанализировать все зафиксированные инциденты, понять, какие события им предшествовали, и построить предиктивные модели зарождения инцидентов более чем реально. Сейчас вопрос в первую очередь упирается не в математику, а в стоимость вычислительных ресурсов и квалификацию аналитиков. Системы распределенного хранения и вычислений уже помогают реализовать многое, но совокупная стоимость владения таким комплексом кажется неподъемной для бюджета enterprise-организации и несоизмеримой с рисками, которые влекут за собой инциденты ИБ. Эту концепцию из долгосрочного прогноза развития кибербезопасности не дает вычеркнуть фотография 1965 года с жестким диском производства компании IBM объемом всего 5 Мб.

Она напоминает о том, что технологические ограничения временны, а значит, и искусственный интеллект, накачанный петагерцами производственной мощности и зетабайтами памяти, в будущем будет способен предсказывать инциденты кибербезопасности, быстро и эффективно анализируя активности в корпоративной информационной сети.

Персональная кибербезопасность тоже не стоит на месте. Скоро шторки на камерах ноутбуков, антивирусы на рабочих станциях и мобильных телефонах перестанут быть достаточной мерой защиты личной информации, когда Интернет вещей не только будет покрывать каждый квадратный метр обитаемой поверхности, но и проникнет вглубь человеческого тела.

К середине 2020-х годов технический директор Google прогнозирует выход на широкий рынок умных гаджетов-имплантатов, и тогда вопросы личной кибербезопасности и физической безопасности гражданина сольются воедино. С появлением встраиваемой в человека микропроцессорной техники взлом одного человека другим может стать таким же обыденным событием, как ограбление на улице поздним вечером в неблагополучном районе.

Существующие проблемы IoT во многом связаны с тем, что при разработке «подключенных» устройств вопросы, связанные с безопасностью, попросту не принимались во внимание. Все попытки как-то изменить ситуацию сейчас похожи на латание трещин в постоянно разрушающейся плотине, когда ниже по реке уже строится очередная дамба с таким же беспечным подходом к проектированию. Уинстону Черчиллю приписывают высказывание «Генералы всегда готовятся к прошедшей войне». Это в полной степени справедливо и для данной ситуации. Решать проблемы прошлого вместо того, чтобы проектировать безопасное будущее, — заведомо проигрышная стратегия.

Будущее персональной кибербезопасности — это личные средства обнаружения целевых атак, сканеры уязвимостей, IDS и web application firewalls. Однако для работы со всеми этими комплексами нужны недюжинные знания, опыт и профессионализм. Поэтому можно предположить, что граждане будут подключаться к SOCам, специализирующимся на персональной киберзащите, круглосуточно готовым отразить атаку. Сейчас мы видим, как растет рынок услуг кибербезопасности для семейных офисов размером с SMB-компании, но с бюджетами enterprise-сегмента. Смещение фокуса сервисных компаний еще на один уровень вглубь, до индивидуальных объектов защиты, — логичный следующий шаг эволюции SOCов, MSSP и MDR, соответствующий тенденциям к удешевлению технологий и развитию искусственного интеллекта.

Будущее представляется максимально автоматизированным. Беспилотные транспортные средства, которые знают, куда и как отвезти пассажиров, «умные дома», управляемые голосом и угадывающие наши желания, тотальная замена физического труда умственным… Все это может создать обманчивое впечатление, что для человека в этом мире не останется другой роли, кроме роли потребителя. Однако этот вариант развития событий опровергает Курт Воннегут в своем романе «Механическое пианино». Развитие технологий и полнейшая автоматизация разделили общество на две неравные группы: потребителей и инженеров. Без последних всевозможные умные системы и фабрики беспомощны, и роль человека остается ключевой в управлении этим миром. Так и в моем варианте будущего: искусственный интеллект никогда не займет место у штурвала киберзащиты. Автоматизация любой сферы не выводит человека из процесса. Она только уменьшает число людей, необходимых для его обслуживания, и повышает требования к персоналу.

В качестве примера можно привести индустрию авиастроения: даже с тем количеством электроники, которой сейчас нафаршированы боевые и гражданские самолеты, пилоты не исчезли как класс. Отдельные и временами впечатляющие эксперименты по созданию беспилотных летательных аппаратов не отстраняют человека от управления. Например, всемогущие дроны Predator все еще управляются оператором, ответственным за принятие решений. Я думаю, что в будущем искусственный интеллект будет выступать помощником или высококлассным специалистом, как программа Джарвис у Тони Старка из вселенной комиксов Marvell. Принятие решений, оценка ситуации, адаптация к изменениям — все это останется прерогативой человека с его профессиональным и жизненным опытом, образованием и талантом.

Эту ситуацию мы сейчас наблюдаем на рынке систем защиты от утечки данных. Сверхскоростной поиск по огромным массивам данных, возможность собирать информацию для последующего анализа и строить многоуровневые графы из имеющихся данных важны и, несомненно, трудноповторимы. Но считать технические особенности DLP-системы ключевыми в вопросах выявления внутренних угроз, исходящих от людей, в корне не верно. Когда мы говорим о внутреннем мошенничестве или рисках, исходящих от инсайдера, важно понять, кто он такой, как себя проявит, какие действия будет совершать не так, как добропорядочный пользователь. Времена, когда для выявления внутреннего нарушителя достаточно было прописать шаблоны поиска текстовой информации или снять цифровые отпечатки с наборов данных, давно прошли. В самом ближайшем будущем задача DLP будет заключаться не в выявлении информации, подходящей под шаблоны поиска, а в предотвращении мошеннических схем и многоходовок, выстраиваемых инсайдерами. Как и раньше, для этого нужно будет собрать информацию и проанализировать ее — ведь детективу нужно с чем-то работать. Но вот главная проблема: понять человека, предугадать действия злоумышленника, – будет неподвластна машине еще очень-очень долго.

Существуют компании, которые долго и упорно пытаются переложить логику аналитиков и экспертов в автоматизированные системы. Их всех объединяет то, что в каждой схеме присутствует человек, корректирующий принятые искусственным интеллектом решения. Это может сработать в том случае, когда мы пытаемся прогнозировать поведение того, что подчиняется законам статистики, физики или больших чисел. Но вот когда объектом исследования становится человек, в случайных местах четких математических формул появляются случайные же переменные, которые могут развернуть результаты моделирования в диаметрально противоположную сторону. Машина способна предугадать, как поведет себя система под воздействием рациональных факторов, но понять, что предпримет человек под влиянием тысяч иррациональных причин, может только другой человек.

Помимо технических компонент в сердце DLP-системы живет не искусственный, а реальный интеллект. Опыт экспертов в различных областях деятельности, профессионалов в сфере психологии, борьбы с мошенничеством, физической безопасности воплощается в математических формулах, в сложных правилах и методах выявления тех людей, которые могут нанести вред компании, бизнесу, а зачастую непосредственно сотрудникам защищаемой организации. В этом смысле система DLP превратилась в кибернетический организм, в котором человеческий разум и опыт рука об руку с высокими технологиями делают то, что раньше казалось невозможным – предсказывают нарушения и преступления, которым еще предстоит случиться. И в этом понимании будущее систем предотвращения утечек данных уже наступило, ведь симбиоз человека и технологий уже знает, что завтра произойдет в вашей организации.

Человечество оторвалось от земли, взлетев на самолете, почти 135 лет назад, а первый компьютерный вирус увидел свет только в 1971 году. В масштабах истории воздухоплавания мы, специалисты в сфере защиты информационных систем, находимся еще где-то на уровне поршневых двигателей и только-только собираемся переходить на реактивную тягу, где существенно возрастут скорости, перегрузки и уровень ответственности. В свете этой гипотезы можно быть уверенным в одном: с какой бы скоростью ни развивалась индустрия информационных технологий, искусственный интеллект еще долго будет работать на вторых ролях у настоящих властелинов кибербезопасности — профессионалов SOCов, MSSP и MDR.

Подписаться

Подписаться Читать в телеграм

Читать в телеграм